今回は少し毛色を変えて将来のチップレットについての話だ。IEDM 2025のショートコースで発表されたAMD FellowのNuwan Jayasena博士による"Memory-Centric AI Architecture through Advanced Packaging and Heterogeneous Integration"の内容をご紹介したい。話としてはInstinct MI300Xが中心になるのだが、なぜInstinct MI300X?という話は最後に説明する。

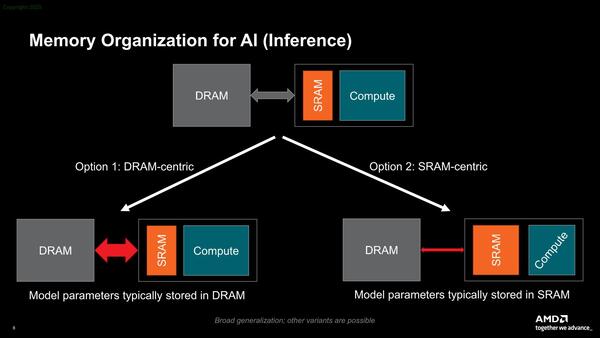

SRAMかDRAMか? AIプロセッサーにおけるメモリー選択のジレンマ

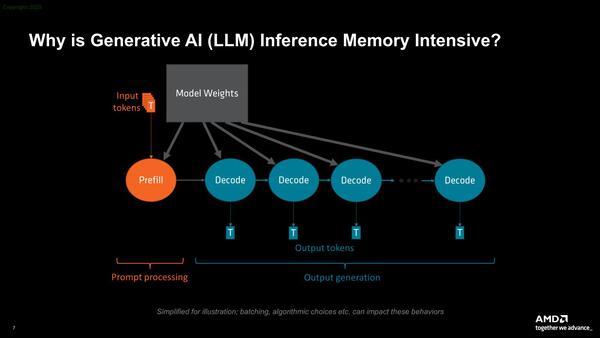

LLMにしても生成AIにしても、昨今のAI処理はとにかくメモリーの利用量が半端ないという話はご存知の通り。これはWeightの数がすさまじいからで、このWeightをどうやってローカルのRAMに押し込むかで性能が大きく変わることになる。

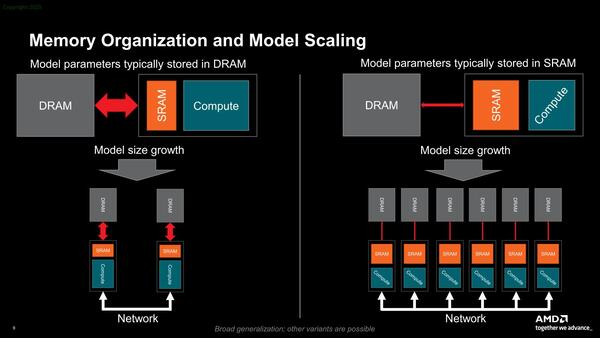

このRAMをSRAM主体にするか、DRAM主体にするかというのが次の問題。一般論としてAIプロセッサーはSRAM主体が多く、GPU系はDRAM主体となる。どちらが良いかは実装に関わってくる問題であるのだが、最近はLLMにおけるWeightの数の急増により、DRAM主体がやや優勢である。

DRAM混載プロセスは20nm世代が最後になっており、今は(積層するにしても)別チップの形になる。それもあってAIアクセラレーターの中にはSRAM主体で実装、というものが少なくない。こうしたケースでは当然WeightはSRAMに格納される

といってもスケーリングさせないとどちらも1つのプロセッサーだけでは処理できないので、結局スケールアップないしスケールアウト(これも議論がいろいろあるがここではおいておく)の形で複数のプロセッサーをつないで処理を分担する格好になる。

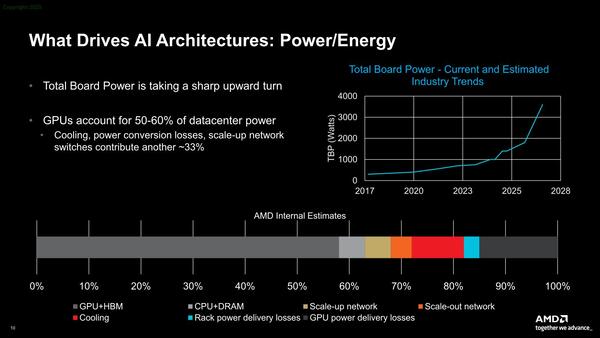

ちなみにプロセッサーの消費電力の内訳が下の画像である。AMDなので当然モデルはInstinct MIシリーズのものと思うが、全体の半分強がGPU+HBMで、残りはその他ということになる。

この連載の記事

-

第863回

PC

銅配線はなぜ限界なのか? ルテニウムへの移行で変わる半導体製造の常識と課題 -

第862回

PC

「ビル100階建て相当」の超難工事! DRAM微細化が限界を超え前人未到の垂直化へ突入 -

第861回

PC

INT4量子化+高度な電圧管理で消費電力60%削減かつ90%性能アップ! Snapdragon X2 Eliteの最先端技術を解説 -

第860回

PC

NVIDIAのVeraとRubinはPCIe Gen6対応、176スレッドの新アーキテクチャー搭載! 最高クラスの性能でAI開発を革新 -

第859回

デジタル

組み込み向けのAMD Ryzen AI Embedded P100シリーズはZen 5を最大6コア搭載で、最大50TOPSのNPU性能を実現 -

第858回

デジタル

CES 2026で実機を披露! AMDが発表した最先端AIラックHeliosの最新仕様を独自解説 -

第857回

PC

FinFETを超えるGAA構造の威力! Samsung推進のMBCFETが実現する高性能チップの未来 -

第856回

PC

Rubin Ultra搭載Kyber Rackが放つ100PFlops級ハイスペック性能と3600GB/s超NVLink接続の秘密を解析 -

第855回

PC

配線太さがジュース缶並み!? 800V DC供給で電力損失7~10%削減を可能にする次世代データセンターラック技術 -

第854回

PC

巨大ラジエーターで熱管理! NVIDIA GB200/300搭載NVL72ラックがもたらす次世代AIインフラの全貌 - この連載の一覧へ