OpenAIは8月6日、大規模言語モデル(LLM)「gpt‑oss」を公開した。従来のChatGPTシリーズは仕組みや学習済みデータが基本的に非公開で、利用はWebやアプリ経由に限られていたが、今回は学習済みモデルを誰でもダウンロードして自由に利用できる形式での提供となる。さっそくgpt‑ossをダウンロードし、ローカル環境での実行方法を確認した。

gpt‑ossとは、なにがすごいの?

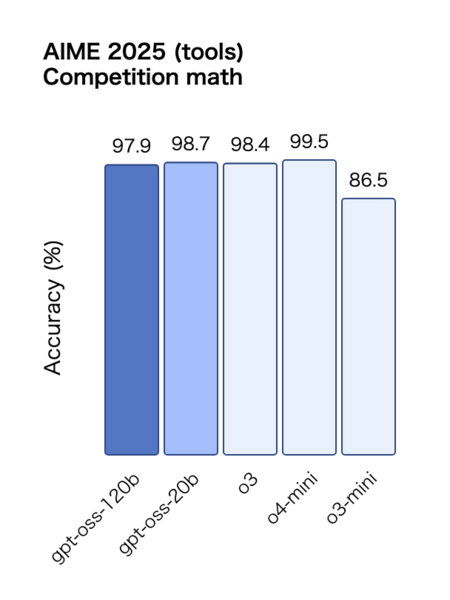

gpt‑ossはオープンウェイト推論モデルで、20B(約200億)と120B(約1200億)パラメータの2種類を提供する。推論(リーズニング)性能に特化し、思考の連鎖(Chain of Thought=CoT)、少ない例からの関数呼び出し、外部ツール連携などに対応している。Tau‑BenchやHealthBench、数学競技AIMEなどのベンチマークでは、同規模の他オープンモデルを上回る性能を示した。

安全性も重視されている。GPT‑4oクラスの社内基準を満たし、プロンプト攻撃や敵対的ファインチューニングへの耐性も確認済み。公開前には外部専門家レビューやRed Teaming Challengeも実施され、オープンモデルとしては異例の徹底ぶりだ。

可用性の面でも柔軟だ。20Bモデルは16GBメモリで動作し、LM StudioやOllamaでWindowsでも試せる。120Bモデルは単一80GB GPUで推論可能で、GroqやHugging Face Inference APIなどクラウドでも運用できる。いずれもApache 2.0ライセンスで提供されており、OpenAIの使用ポリシー(gpt-oss usage policy)に準拠すれば、無料かつ商用利用も可能だ。

このようにgpt‑ossは高い推論力・安全性・幅広い利用性を兼ね備えた次世代オープンモデルといえる。

この連載の記事

-

第45回

AI

面白すぎて危険すぎ! PCを“勝手に動かす”AI、OpenClaw(旧Moltbot/Clawdbot)とは -

第44回

AI

「こんなもの欲しいな」が、わずか数時間で形になる。AIツール「Google Antigravity」が消した“実装”という高い壁 -

第43回

AI

ChatGPT最新「GPT-5.2」の進化点に、“コードレッド”発令の理由が見える -

第42回

AI

ChatGPT、Gemini、Claude、Grokの違いを徹底解説!仕事で役立つ最強の“AI使い分け術”【2025年12月最新版】 -

第41回

AI

中国の“オープンAI”攻撃でゆらぐ常識 1兆パラ級を超格安で開発した「Kimi K2」 の衝撃 -

第40回

AI

無料でここまでできる! AIブラウザー「ChatGPT Atlas」の使い方 -

第39回

AI

xAI「Grok」無料プラン徹底ガイド スマホ&PCの使い方まとめ -

第38回

AI

【無料】「NotebookLM」神機能“音声概要”をスマホで使おう! 難しい論文も長〜いYouTubeも、ポッドキャスト化して分かりやすく -

第36回

AI

無料で「Gemini 2.5 Pro」が使える!グーグル「Gemini CLI」の使い方を簡単解説 -

第35回

AI

【無料】グーグル神AIツール5選 「Google AI Studio」はこれがやばい - この連載の一覧へ