FIXER cloud.config Tech Blog

Azure Machine Learningで作ったモデルをAKSにデプロイしてみる

2021年03月09日 11時00分更新

本記事はFIXERが提供する「cloud.config Tech Blog」に掲載された「Azure Machine Learningで作ったモデルをAKSにデプロイしてみる」を再編集したものです。

目次

はじめに

回帰モデルを作成してAKSにデプロイする

Azure Machine Learning リソースを作成する

コンピューティングクラスターを作成する

モデルのテンプレートを利用してトレーニングする

リアルタイム推論パイプラインを作成して実行する

推論クラスターを作成する

推論クラスターにアプリをデプロイする

アプリをテストする

おわりに

参考

はじめに

以前、Azure Machine Learningで回帰モデルを作成するやり方について記事を書きました。

機械学習でモデルをトレーニングしたら、それを何らかのアプリで使用できるようにする必要があると思います。

Azure Machine Learningでは、そのモデルをアプリとしてデプロイして利用する方法が整備されていて、それを利用することで作成したモデルをWebAPIで簡単に利用できるようになります。

今回はその方法の共有です。

回帰モデルを作成してAKSにデプロイする

それでは実際に手を動かしていきます。

以前の記事で作成したAzure Machine Learningのリソースやモデルがあればそれを利用してもいいですが、今回は今回でリソースの作り方から解説していきます。

Azure Machine Learning リソースを作成する

まずは前回同様Azure Machine Learningのリソースを作成します。

ポータル画面上部の検索窓から「Azure Machine Learning」を検索し、青いフラスコみたいなアイコンの「Machine learning」を選択します。

画面左上の「+追加」をクリックしてリソースの作成画面に入ります。

リソースの作成画面では適当なワークスペース名を設定します。

リージョンは基本的に今作業している地域から近い場所が望ましいですが、後述の理由で別のリージョンを設定した方がいい場合もあります。

それ以外は基本そのままで「確認及び作成」ボタンをクリックし、検証されたら「作成」をクリックしてリソースを作成します。

しばらく待ってリソースが作成されたらそのリソースに移動し、「スタジオの起動」ボタンを押してスタジオ画面に移動します。

コンピューティングクラスターを作成する

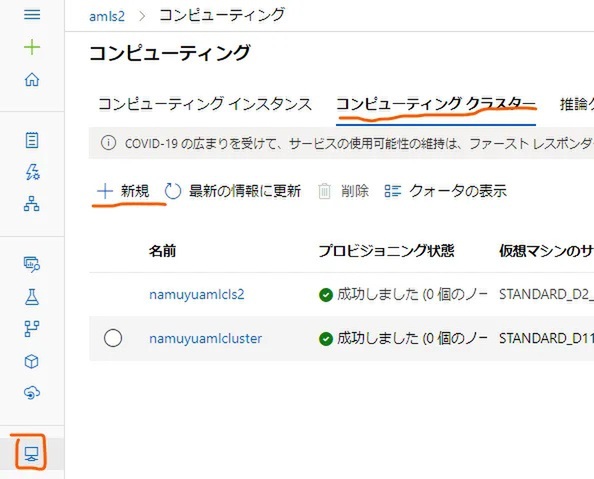

スタジオ画面に移動したらまずはモデルのトレーニングに使用するコンピューティングクラスターを作成します。

スタジオ画面の左端のアイコンの一覧から下から4つ目、コンピュータのモニターのようなアイコンをクリックし、開いた画面の中でタブを「コンピューティングクラスター」に移動します。

そこで「+新規」のボタンをクリックし、コンピューティングクラスターを新規作成します。

コンピューティングクラスターの設定画面ではコンピューティングクラスターの性能や名称を設定しておきます。

性能はStandard_D11程度が妥当かと思います。

後はコンピューティング名を設定し、「作成」ボタンを押してコンピューティングクラスターを作成します。

モデルのテンプレートを利用してトレーニングする

次はモデルを作成してトレーニングしていきます。

前回の記事ではこの部分を手作業で行いましたが、学習用のサンプルモデルはテンプレートにあるので、今回はそれを利用します。

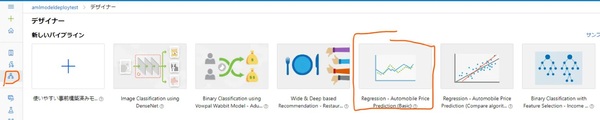

スタジオ画面左端のアイコン一覧で「デザイナー」のアイコンをクリックし、デザイナーのトップ画面に移動します。

そして、その画面の上部に「Regression – Automobile Price Prediction (Basic)」というサンプルがあるので、これをクリックします。

これは自動車の価格を予測する回帰モデルで、メーカーやドアの数などといったその車の要素から価格を予測します。

サンプルをクリックすると前回の記事で作成したようなモデルトレーニングのパイプラインが自動生成されているので、さっそくモデルのトレーニングを行っていきます。

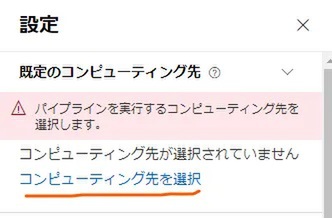

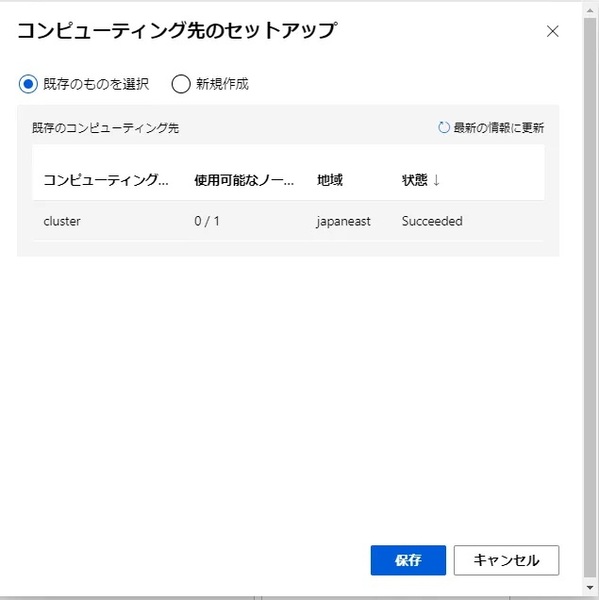

まずは、トレーニングを行うコンピューティング先を指定します。

パイプラインのデザイナー画面の右の方から、「コンピューティング先を選択」をクリックします。

するとコンピューティング先のセットアップのモーダルが出てくるので、作成したコンピューティングインスタンスを選択し、「保存」をクリックします。

これでモデルのトレーニングを行うクラスターがセットアップできたので、それを使用してトレーニングを行っていきます。

デザイナー画面の上部に「送信」のボタンがあるのでこれをクリックします。

セットアップが面では実験は「新規作成」をクリックし、実験名を入力して「送信」ボタンをクリックして実験を開始します。

そこそこ時間がかかるのでしばらく待ちましょう。

ただ、最近はAzure上のVMのリソースがひっ迫しているのか、VMの割り当てに時間がかかりまくった挙句「VMが足りなくて割り当てられなかったよー」というようなメッセージが表示されることがあります。

Azure Machine LearningでのVMリソースは基本的に普段は割り当てず、トレーニングを行う時にだけ払い出すようにできます。(例えば、クラスター作成時に「最小クラスター数」を0にした場合とか)

その際、「よしトレーニングやるぞVM確保しなきゃ」となったタイミングでそのリージョンにVMの数が足りないとそれによってVMの確保に失敗することがあるためです。

特に自分の場合東日本リージョンで何度か試したのですが何度やってもVMが確保できなかったため、別のリージョンにAzure Machine Learningのリソースを作り直してこの先の作業をやり直したりしました。

このエラーが出たら、Azure Machine Learningのリソースの再作成からやり直す羽目になります。

リアルタイム推論パイプラインを作成して実行する

回帰モデルのトレーニングが完了するとデザイナー画面の上部に「推論パイプラインの作成」というドロップダウンメニューが出てくるのでこれをクリックして、「リアルタイム推論パイプライン」をクリックし、リアルタイム推論パイプラインを作成します。

これによって既存のデザイナーのパイプラインにいくらか要素が追加されたパイプラインが新たに生成されます。

新たに追加されたパイプラインでは、それまでのパイプラインの書くモジュールに加えて、「Web Service Input」と「Web Service Output」という要素が追加されています。

パイプラインが新たに生成されたら、こちらも同様に画面上部から「送信」をクリックしてモデルのトレーニングを行いましょう。

モデルのトレーニングを行っている間に次の工程である推論クラスターの作成を行います。

推論クラスターを作成する

推論クラスターは、回帰モデルをWebアプリとしてデプロイする先のAKSのkubernetesクラスターになります。

これを作成します。

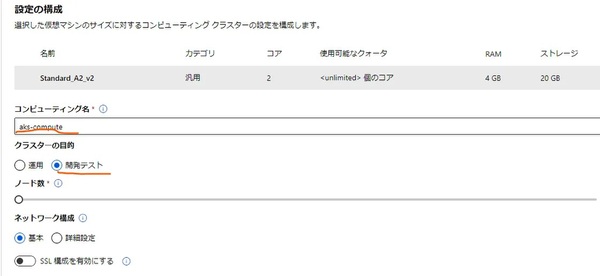

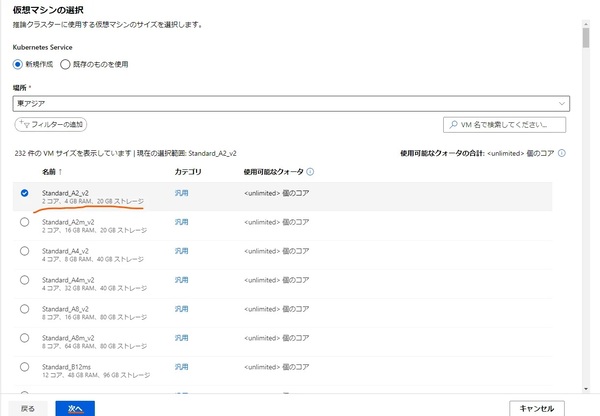

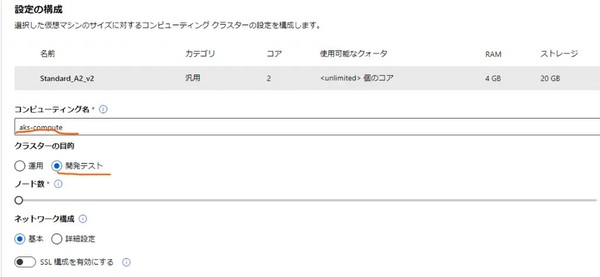

再び、コンピューティングの画面に移動し、「推論クラスター」のタブを選択し、「作成」のボタンをクリックします。

まずは作成するクラスターのVMサイズを選択しますが、安めのサイズを選択しておきます。

次の画面では分かりやすいコンピューティング名を設定し、クラスターを作成します。

推論クラスターにアプリをデプロイする

推論クラスターが作成でき、リアルタイム推論パイプラインのモデルトレーニングが完了したら、リアルタイム推論パイプラインの編集画面に戻ります。

画面の上部の「送信」ボタンの横に「デプロイ」ボタンが有効になっているかと思います。

これをクリックします。

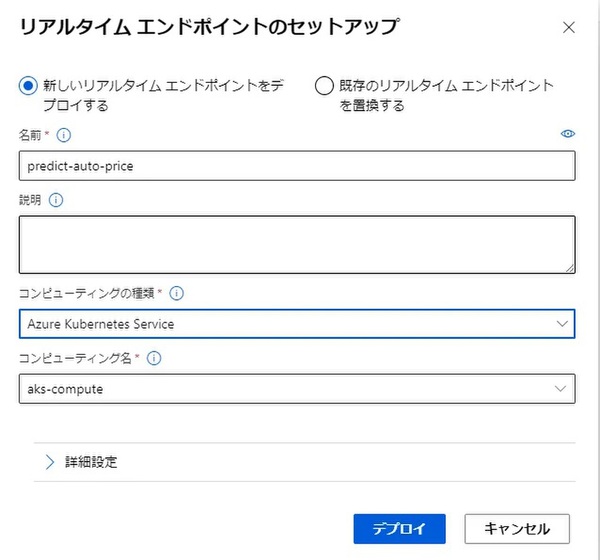

すると、「リアルタイムエンドポイントのセットアップ」というモーダルが出てくるので、回帰モデルをWebアプリとしてデプロイする準備をします。

分かりやすい名前を設定し、コンピューティングの種類としては「Azure Kubernetes Service」を選択します。

その下のコンピューティング名には先程作成した推論クラスターを選択し、「デプロイ」をクリックして回帰モデルをWebアプリとしてAKS上にデプロイします。

アプリをテストする

これでモデルがAKS上で利用できるようになったのですが、実際にそのモデルを試してみましょう。

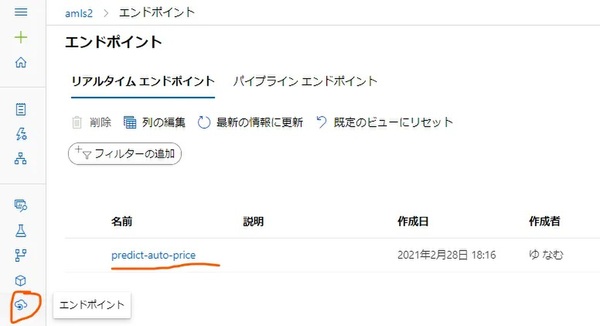

今度は、スタジオ画面左は地のアイコン一覧から、「エンドポイント」をクリックします。

するとリアルタイムエンドポイントの一覧が表示されるので、先程作成した名前のエンドポイントを選択します。

エンドポイントの詳細画面が表示されますが、画面上部から「テスト」タブを選択します。

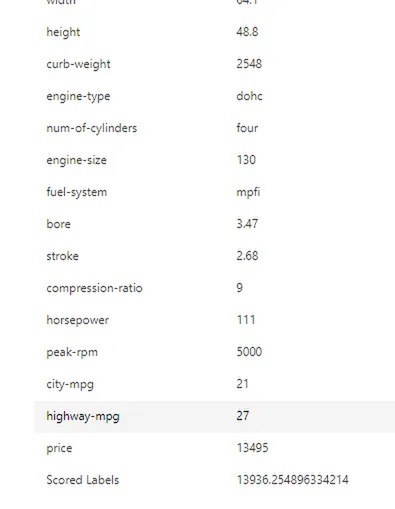

すると、作成した回帰モデルにリクエストする各種パラメータの入力フォームが出てくるので、ドアの数、メーカー名などを好みに設定して「テスト」ボタンを押します。

すると、画面右にテスト結果の出力が表示されます。

これを下の方までたどっていくと「Scored Labels」という値があるかと思います。

この値が、今回の回帰モデルで予測された「price」の値になります。

これにて後ろでテストが行われ、回帰モデルがWebアプリとしてAKS上にデプロイされていることが確認できました。

おわりに

今回はAzure Machine Learningで作成したモデルをWebアプリとしてAKS上にデプロイする方法を共有しました。

WebAPIとしてデプロイすることで他アプリからも利用しやすくなり、また、AKS上で独立したサービスとすることでモデルの更新などにも対応しやすくなります。

モデルをアプリ化して独立したアプリとするという考え方はAzure Machine Learning以外のプラットフォームでも使えそうな概念かと思うので、よっしゃこれから機械学習アプリを作るぞという際には心にとめておいていただけると幸いです。

参考

なむゆ/FIXER

最近インフラ始めました。

k8s社内最強を目指します。

本記事はアフィリエイトプログラムによる収益を得ている場合があります