米AMDは、企業内でのAI運用(エンタープライズAI)に最適化された最新GPU「AMD Instinct MI350P PCIe」を発表した。これまでHPCや大規模クラウド向けが中心だったMI350シリーズに、汎用性の高いPCIeフォームファクターモデルが加わることになる。

既存のサーバーにInstinctのパワーを

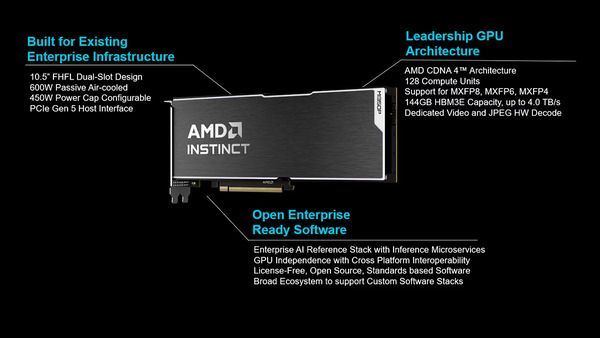

Instinct MI350P PCIeは、最新のAMD CDNA 4アーキテクチャーを採用したAIアクセラレーターだ。最大の特徴は、多くの企業が標準的に採用しているPCIeスロットに対応した点にある。

これにより、高価な専用設計のサーバーを新規導入することなく、既存のラックマウントサーバーなどのインフラを活用して、LLM(大規模言語モデル)の推論や微調整(ファインチューニング)といったAI業務を自社環境(オンプレミス)で実行することが可能になる。

大容量メモリーと電力効率を両立

スペック面では、HBM3eメモリーを採用することで圧倒的なメモリー帯域幅を確保。エンタープライズAIで求められる大規模なデータ処理を低遅延でこなす性能を備えている。また、PCIe版となることで、電力設計や冷却要件が緩和されており、データセンター全体の運用コスト(TCO)削減にも寄与するという。

AMDのJack Huynh氏は、「すべての企業がAIの力を享受できるよう、柔軟なハードウェアの選択肢を提供することが重要だ」と、その狙いを語っている。

NVIDIA H100/H200への強力な対抗馬に

現在、エンタープライズAI市場ではNVIDIAの独走が続いているが、AMDはオープンなソフトウェアプラットフォーム「ROCm」の拡充と、このMI350P PCIeの投入により、その牙城を崩しにかかる。

特に、既存のx86サーバー資産を活かしつつ、最新のAIパフォーマンスを手に入れたい企業にとって、MI350Pは有力な選択肢となるだろう。発売時期や詳細なベンチマーク結果については、今後の続報を待ちたい。

本記事はアフィリエイトプログラムによる収益を得ている場合があります