画像を使った脅迫や嫌がらせなどを防ぐ:

FacebookとInstagram、未成年者の性的な画像を削除する取り組み「Take it Down」に参加

2023年02月28日 15時15分更新

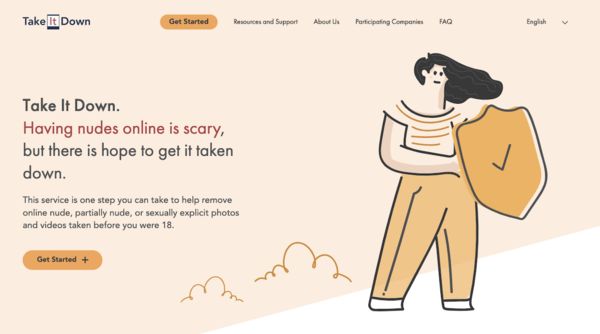

画像:Take it Down

メタは2月27日、同社が運営するSNS、FacebookとInstagramが、青少年のヌードや性的に露骨な画像のオンラインでの拡散を防ぐ取り組み「Take it Down(取り下げ)」に参加すると発表した。ユーザーが専用サイトから問題のある画像や動画を申請すると、メタが各サービスで削除や再投稿防止措置を実行する。

画像を使った脅迫や嫌がらせなどを防ぐ取り組み

Take it Downは、全米行方不明・被搾取児童センター(National Center for Missing and Exploited Children=NCMEC)が運営するプラットフォーム。メタが創設メンバーとして開発を支援してきた。

プラットフォームは18歳未満の青少年のヌードや性的に露骨な画像や動画の拡散を防ぐのが目的。このような画像や動画を使い、写っている人物に対して脅迫や嫌がらせ、性的な接触を強要するといった行為を防ぐことを狙いとしている。

データの削除と再投稿防止措置を実施

Take it Downの申請手続きは以下のような流れとなる。

- ユーザーが専用サイトからTake it Downの利用を申請する

- Take it Down参加企業が申請された画像や動画を削除。再投稿防止の措置もとる

申請にあたっては画像や動画ファイルそのものではなく、選択したファイルに対して付与されるハッシュ値を使用する。ユーザーは付与されたハッシュ値をTake it Downの担当者へ送信すれば申請完了となる。ハッシュ値から元のデータを復号することはできないため、担当者に元の画像や動画を見られる心配はない。

画像や動画は削除に加えて再投稿防止措置もとられるため、将来的な拡散もある程度防ぐことが可能だという。

Take it Downを利用できるのは、18歳未満の青少年(本人)、彼らの保護者または信頼できる大人、18歳未満の頃の自分が写った画像や動画を拡散されたくない大人など。

本記事はアフィリエイトプログラムによる収益を得ている場合があります