2019年3月20日に開催された第15回目JAWS-UG横浜の勉強会は、発足前となるMedia-JAWSとのコラボイベントだ。4K配信の本格化、5Gの導入、動画配信事業者の台頭など激変のメディア業界をクラウド活用でどのように生き残るか? さまざまな知見が得られた勉強会の模様をお伝えする。

AWSを用いたライブ配信の構成の基礎(アイレット 土田さん)

夜がゆるゆると忍び寄り、街の灯りがとてもきれいな横浜。JAWS-UG横浜のホームである馬車道アトラシアンオフィスで始まった第15回の勉強会だが、Media-JAWSの第0回を兼ねているため、最前列ではけっこうガチ目なカメラが置かれ、ガチっぽい人たちがライブ配信を行なっている。

会場提供元のアトラシアンの勉強会である「AUG Tokyo」の紹介に続いて、登壇したアイレットの土田和広さんは、「AWSを利用したライブ配信構成まとめ」のLTを披露した。昨年、入社した土田さんはアイレット動画配信のチームに配属されており、放送系のイベントであるInterBEEなどにも登壇しているという。

アイレットの土田和広さん

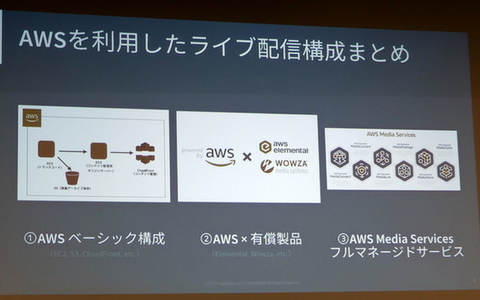

今回の土田さんが話したネタは、Media JAWSのイントロに最適とも言えるAWSを用いたライブ配信の構成について。たとえば、cloudpackが「streampackLIVE」という配信サービスで用いているAWSベーシック構成はEC2、S3、CloudFrontなどを用いた基本構成だが、「Wowza Streaming Engine」などの有償製品を用いると複数の異なるコーデックで配信できるという。昨年、青森ねぶた祭の花火大会を秋葉原のUDXに4K配信した事例でも、このWowza Streaming Engineを用いているという。

最近ではフルマネージドサービスである「AWS Media Services」を利用する方法もある。構築やメンテナンスは楽だが、ドキュメントが英語で未実装の機能もあるとのこと。最近はAWS Media Servicesを用いて構築したいという案件も増えているという。

ライブ配信構成のまとめ

さっぽろ雪まつりのライブ配信失敗談(HTB 三浦さん)

「さっぽろ雪まつり配信におけるMediaLive失敗談」というタイトルで中継の舞台裏を北海道テレビ放送(HTB)の三浦一樹さんだ。放送とITを融合させ、いろいろやっているという三浦さんが「この1週間のうちにdボタン押したことある人!」と質問を投げかけると、メディア関係者の多い会場はなぜか異常に沸く。いや、うちは子どもがちゃんとdボタン押してますよ。

北海道テレビ放送(HTB) クロスメディアコミュニケーションセンター 三浦一樹さん

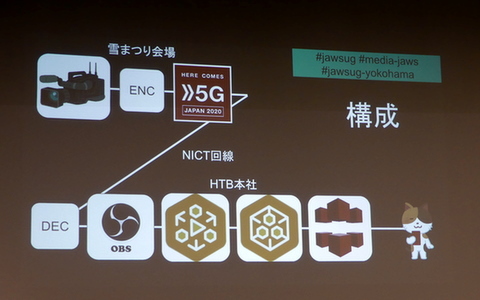

さて、今年で70回目を迎えるさっぽろ雪まつりを配信したHTB。大通公園を中心にさまざまな雪像が並ぶ北海道ならではの祭りだが、今年は最高気温がマイナス12度という過酷な環境の中、さまざまな実証実験が繰り広げられた。NICTと共同で8K非圧縮映像伝送を行なったほか、ドコモとの5Gの共同実験で雪像へのプロジェクションマッピングを4K配信するプロジェクトを進めたという。ちなみに会場に降り積もる雪は重機で除去し、ケーブルを通したパイプ埋めるというヘビーデューティな作業だったそう。

雪まつり会場のライブ配信構成

失敗談1つは「AWS Media Servicesだとそもそも4K配信できない」ということ。「いや、それ根本的にダメじゃん」という話だが(笑)、三浦さんの「ともかく時間もなかったり、インプットの選択肢にも『UHD』とあったので大丈夫だと思った」という言い訳にはうなづいてしまう。しかし、実際にやってみたら、本番の12時間前にエラーがはき出されて、どうしようという状態。ちなみに、当日は現場にいたJstreamに助けてもらったとのことで、ここでは三浦さんに代わってお礼を言っておこうと思う。

また、意図しない請求もあった。「『EMIT_OUTPUT』だと入力断でも黒味のストリーミングが止まらない」(三浦さん)とのことで配信が止らずに課金され、結局は顛末書を書いたという。教訓としては、AWS Budgetsでは予算アラートを上げられるので、きちんと設定しましょうとのこと。

HTBとしてはAWS Media Servicesを本番運用で使ったのは今回が初めてだったが、配信の労力は明らかに減ったという。三浦さんは、「キー局のような4K機材を持てない地方局にとって、4K配信はクラウドに頼らざるをえない。AWSはなにとぞ4K対応を」とまとめた。

AIを用いた自動字幕を試してみた(TXCOM 段野さん)

3番手であるテレビ東京コミュニケーションズ(TXCOM)の段野 祐一郎さんは、今回のMedia JAWSの発起人でもある。「AWSもメディア関係のサービスが増えており、5Gや映像配信なども業界で盛り上がっているので、専門のJAWSを立ち上げようと思いました。そうしたらJAWS-UG横浜でぜひ初回やってみてはという声をいただき、やらせてもらうことにしました」とのことだ。

テレビ東京コミュニケーションズ 段野 祐一郎さん

段野さんはテレビ東京でカメラマンを経て、現在は子会社のテレビ東京コミュニケーションズで「TVer」などの見逃し配信サービス、ライブ配信、同時再送信システムを担当している。段野さんは、「5G時代を前に映像メディアは盛り上がっており、個人のスマホで手軽に映像を配信できる時代になってきた」と業界を俯瞰。一方で、企業がビジネスとして映像配信するには、いろいろ考えなければならないことも多く、映像配信に強いエンジニアも少ない。その点、さまざまな機能をマネージドサービスで提供するAWSは映像メディア界の救世主と言えるという。

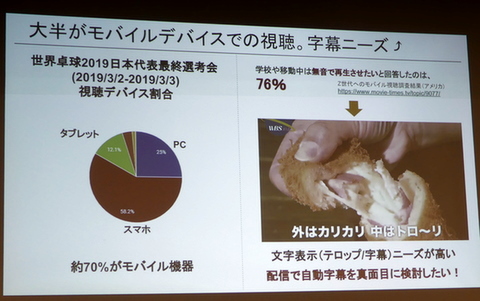

今回試したのは段野さんが試したのは、AIを用いた自動字幕だ。現在、映像配信においては視聴デバイスの7割がモバイルで、米国の調査でも移動中や学校では無音で再生させたいというニーズが高いという。そのため、画面の上に文字の字幕を載せるニーズは高まっており、今回は個人的な興味で自動字幕を試してみたという。

モバイル時代、字幕のニーズは高い

もともと字幕はWebと同じく、アクセシビリティを目的としており、耳の不自由な視聴障害者やお年寄りでもきちんと内容を理解できるように作られたもの。とはいえ、外国語の翻訳を表示したり、音の出しにくい電車やオフィスなどでのコンテンツ視聴にも利用できる便利な技術であり、検索エンジンにメタデータを提供できるため、検索ランクを向上させるSEO対策にもなる。

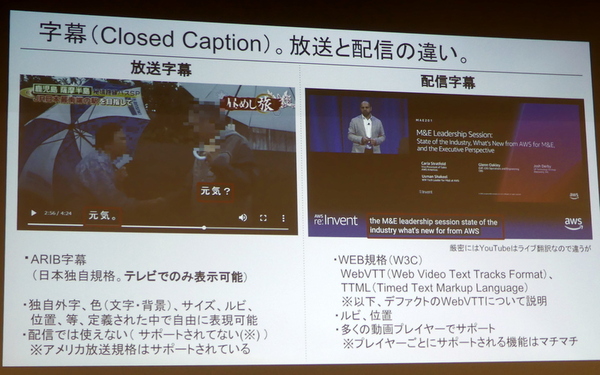

種類としては、映像に文字を焼き込む方法のほか、オン/オフ可能な「クローズドキャプション」という技術がある。また、放送ではテレビでのみ表示可能な「ARIB字幕」という日本独自規格があり、独自の外字、色、サイズ、ルビ、位置などが利用できる。一方、映像配信での字幕はWebと同じW3CでWebVTTやTTMLという定義されており、多くの動画プレイヤーがサポートしている。また、リアルタイム字幕に関しては、前述したクローズドキャプションで特定のインターバルで字幕を表示する方法と、タイピングや自動認識でリアルタイムに変換する方法があるという。

AWSサンプルで試した結果、得られた学びとは?

今回字幕を試すにあたって参考したのはAbemaTV。Abema TV AIポンというプロジェクトではGoogleの音声認識サービスを使ったリアルタイム字幕をいち早く導入しており、テレビ業界では大きな話題になったという。「誤変換も多いけど、それがかえって面白かったり、間違っていても意外と理解できる」(段野さん)とのことで、誤変換がむしろ価値を出せているところが面白いようだ。

段野さんはAbema TV AIポンはどのように動いているのかを妄想する。まず放送から音声を分離し、不要語の削除や放送禁止用語のマスクなどを施し、Google Cloud Speech APIに渡す。その後、出力されたテキストをテロップとして生成し、映像に合成して配信する。こうした一連の処理をいかに低遅延で、コストを抑えてやるかがポイント。「映像が少し遅れてもよいので、できればクローズドキャプション。しかもクラウド上で全部処理したいと段野さんは考えた。

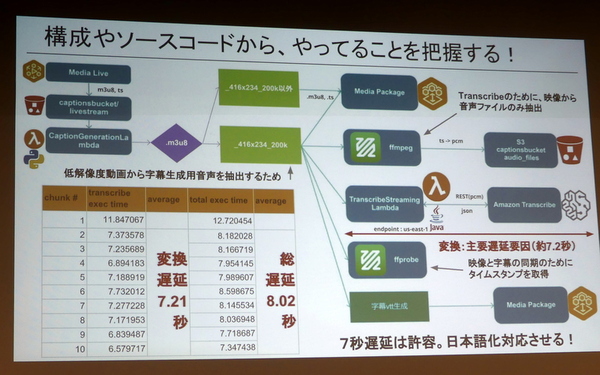

さっそく作ってみようと考えていたら、GitHub上のaws-sampleによさそうなものがあったので活用してみたという。仕組みとしてはS3バケットに格納された低解像度動画からLambdaで音声のみを抽出し、Amazon Transcribeに送り、結果のJSONファイルを取得。タイムスタンプを元に映像とテキストを同期させ、字幕として出力するというものだ。Transcribeの処理でおおむね7~8秒という遅延が発声するため、リアルタイムの字幕を出すのにはギリギリだという。とはいえ、現状はTranscribeが日本語対応していないので、今回は他社のSpeech to Textを用いている。

段野さんはニュース番組を例にデモを披露したが、アナウンサーの声では精度も高く、遅延もあまり感じられなかった。しかし、音声の聞き取りずらい取材の声になると、なかなか破天荒な字幕になってしまった。とはいえ、実践した意味は大きく、AWSのサンプルがPoCに最適なこと、カスタマイズするポイントなどがわかったという。3月時点ではAmazon Transcribeは英語(米、英、オーストラリア)、スペイン語(米)、フランス語(カナダ)のみの対応。日本語対応を熱望し、段野さんのセッションは終了した。

その後、イベント後半ではIMAGICA Lab. 蜂須賀さんが「あなたの知らない怖い話~メディアコンテンツに迫る魔の手~」と題したセキュリティ対策の話を披露。また、NTT東日本の里見さんが「DXGWは海外映像配信で使えるのか? MediaConnectの事例を交えながら」というテーマで、AWSを利用して海外にコンテンツを配信する例を元に、VPC PeeringとDXGWでの伝送を試した実証実験の結果について説明した。

JAWS-UG横浜との共催行なわれた今回のMedia-JAWSだが、4月24日にはMedia-JAWSも正式に立ち上がり、勉強会もハイペースで開催されている。放送・映像業界での活用事例がディープに聞けるイベントなので、次回以降もぜひチェックしてもらいたい。

本記事はアフィリエイトプログラムによる収益を得ている場合があります