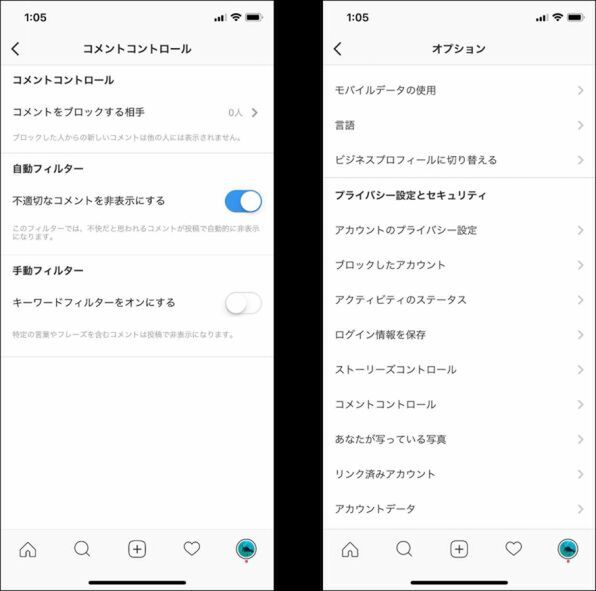

Instagramは2018年5月1日(米国時間)、いじめコメントを自動的にブロックし、非表示にするフィルターを導入したと発表。

機械学習(マシンラーニング)を応用し、利用者が嫌がらせやハラスメントを目的としたコメントを目にする必要がないように自動的にブロックする。問題が繰り返し発生した場合、警告を発し、いじめに関わっているアカウントに対してInstagramが対応策を講じる仕組みだという。

今回のコメントフィルターは、2017年6月に導入した不適切なコメントを自動的に非表示にするフィルター(主に特定のグループを標的とした誹謗中傷など、悪質なコメントが削除対象)に改善を加えたもの。特定の利用者の外見や人格を攻撃したり、心身の健康を脅かすコメントが非表示の対象になる。

Instagram共同創業者、兼最高経営責任者のケビン・シストロム氏は「本日よりInstagramでは、利用者への嫌がらせを目的とした、いじめコメントをフィルタリングする機能を導入します。私達はInstagram上でのいじめを容認しません。Instagramのコミュニティ規定では常に、プラットフォーム上でのいじめを禁止してきました。今回導入する新機能は、Instagramを思いやりにあふれる場所として維持していく取組みを、さらに一歩前進させるものです」と述べている。

本記事はアフィリエイトプログラムによる収益を得ている場合があります