ソニーが1月20日、「mocopi」というモバイルモーションキャプチャーを発売した。とても手軽なモーションキャプチャーで、デザインも良い。モーションキャプチャーが気になっていた筆者もさっそくゲットした。

オリジナルのモデルを作ろう!

公式サイトによると、「mocopi」のアプリはVRM形式のモデルをモーションキャプチャーで動かせるらしい。

そういえば、pixivが提供している「VRoid Studio」で作ったモデルはVRM形式で書き出せる。

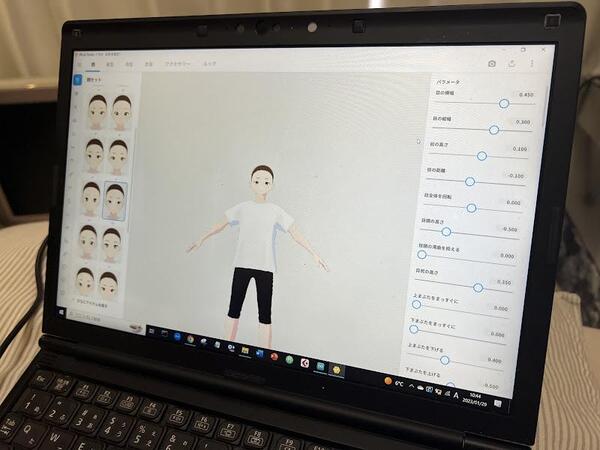

「VRoid Studio」というのは、お絵描きをするようにキャラメイクができるソフトウェアである。

「mocopi」が届く前に、「VRoid Studio」でオリジナルのモデルを作ってみよう。動かすモデルはオリジナルなほうがテンション上がるからね。

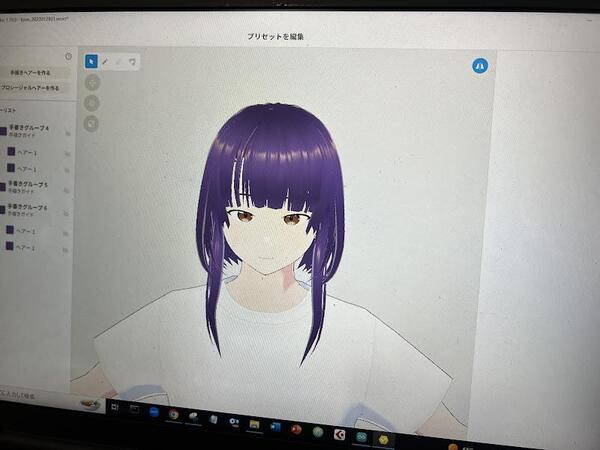

「VRoid Studio」では、お絵描きをするように髪の毛を描いたり、メイクを施したりすることができる。

2Dのお絵描きをするように3Dが作れるのは面白い。

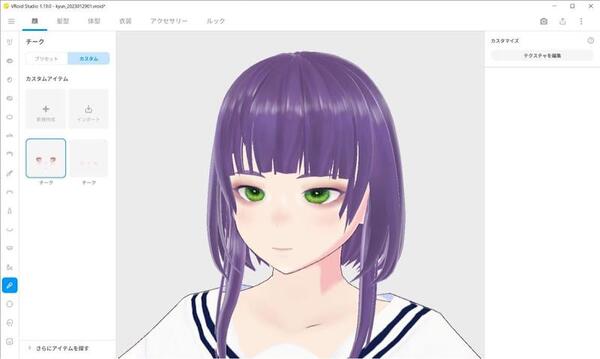

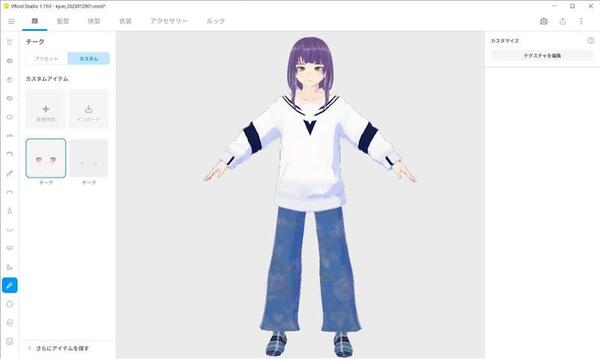

テクスチャなしの状態で上記のようなモデルだったのが、テクスチャを描いていくことで、下のようなモデルになる。

髪の毛、目、メイク、服のテクスチャを描いている。

このモデルを自由にモーションキャプチャーで動かせると思うと楽しみだ。

わくわく!開封の儀

「mocopi」が届いたので、開封していく。

箱の底にはセンサーを身体に取り付けるバンドが入っていた。

バンドに各センサーのマークのタグが付いていたり、親切設計。

でもこのタグすぐなくすからバンドに布か刺繍で付けてほしかったな……。

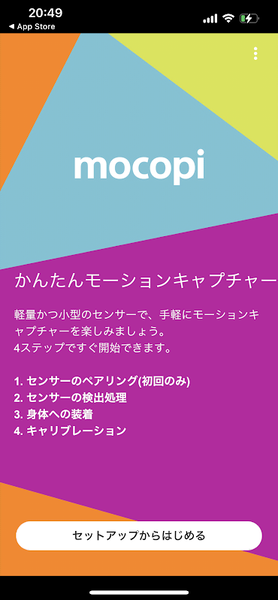

アプリを開いてセンサー装着!

アプリをスマホに入れて、試してみる。

最初に、やることリストがあってからスタートするの親切だなー。

まずは、センサーとアプリを接続する。

センサーのボタンを押して、センサーを動かさない状態でおくとアプリと接続される。

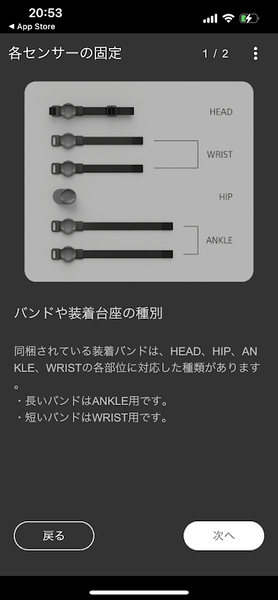

次に、センサーをバンドに固定する。

固定はマグネットで、気持ちよくカチッとハマる。

センサーをバンドに取り付けたら、身体にバンドを巻いていく。

各バンドの取り付け方もアプリで親切に見られるようになっていたので、簡単に取り付けられた。

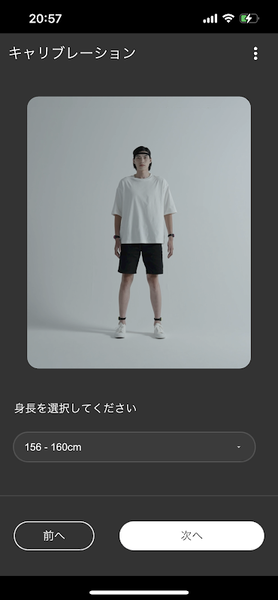

Let'sキャリブレーション!

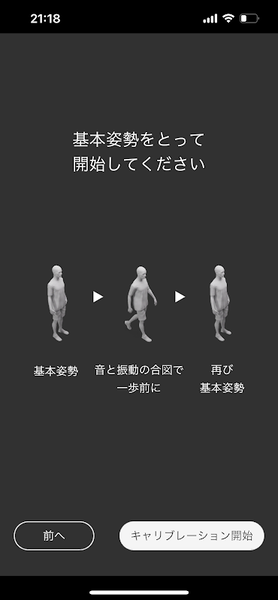

バンドが巻けたら、キャリブレーションをする。

基本姿勢をとってしばらくすると、合図があるので、一歩前に前進する。

これ、1つ難しい点がある。慣れれば問題ないのだが、「キャリブレーション開始」ボタンをアプリで押した瞬間にキャリブレーションが開始する。

つまり、ボタンを押す瞬間には既に基本姿勢になっていないと基本姿勢に動くモーションがキャリブレーションに入ってしまう。

スマホの画面を見ていると、手が顔の前にあるので、基本姿勢を取ることはできない。

つまり、「キャリブレーション開始」ボタンを押さずに指を「キャリブレーション開始」ボタンの上に準備して、基本姿勢を取って、それからボタンを押す必要がある。

「キャリブレーション開始」ボタンを押してからのカウントダウンがもう少し長いか、カウントダウンをバイブレーションで教えてくれるといいなと思った。

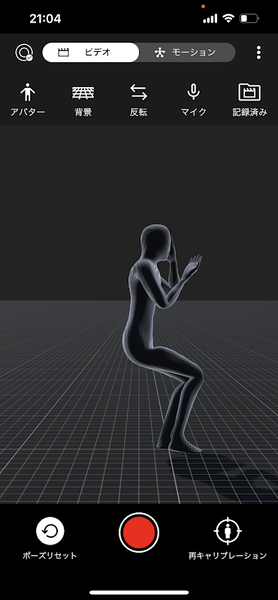

Let'sモーションキャプチャー!!

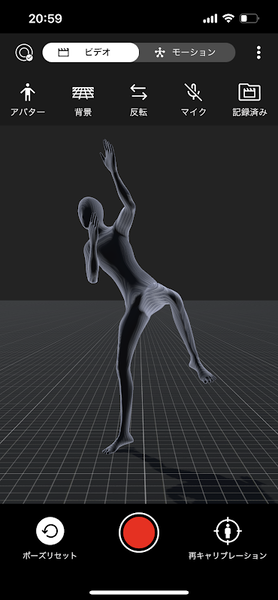

やった!ついにモーションキャプチャーでモデルを動かせるぞ!!

自分の動作を客観的に見ることで、自分が普段あまり身体を動かせてないことを実感する。

あと、スマホ見てるからいつも右手が顔の前にあるんだな……。

モーションキャプチャーを使いこなすにはモーションキャプチャーに適した動きを習得する必要がありそうだ。

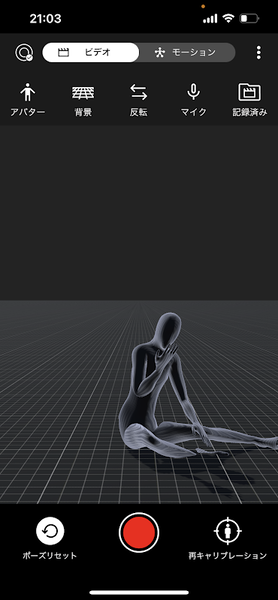

ずっと立っているのは大変なので、座ってみたらどうなるのか知りたくてテストしてみた。

あぐらをかくとあぐらにならないことが多かった。

椅子に座るのは、脚が交差してしまうことがあるがいけそう。

「mocopi」では、モデルを動かした動画を保存することと、モーションを記録すること、転送することができる。

動画はグリーンバックに設定可能なので、動画編集ソフトを使えば、背景と合成することが可能だ。

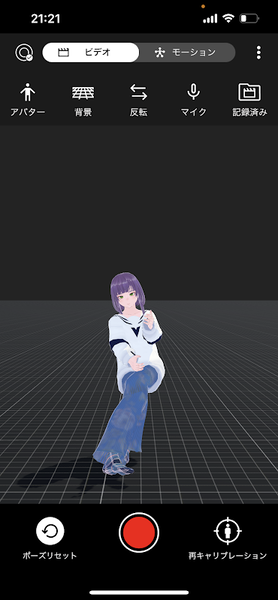

自分のモデルを動かすぞー!

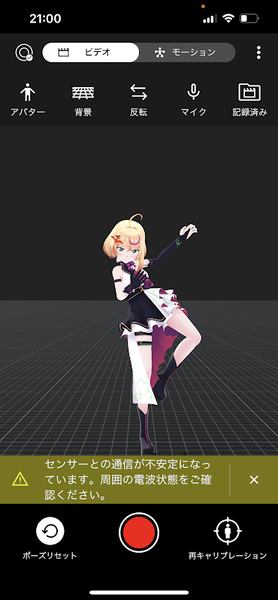

次に、「VRoid Studio」で作った自分のモデルを動かしてみる。

スマホをパソコンにつなげると、パソコン上のモデルをアプリに転送することができる。詳しくは公式のヘルプガイド( QM-SS1 | ヘルプガイド | カスタムアバターを取り込む (sony.net) )を参照されたい。

自分のモデルが読み込めたときはなんだかドキドキした。

組み立てたロボットに火入れ(初めての電源入力)したときの感覚に近い。

最初なぜか読み込めただけで動かせなかったのだが、アプリを再起動してキャリブレーションしなおしたところ動かせた。

かわいい存在が自分の動作で動いている感覚というのを知って驚いた。

この魔力にはそりゃハマるわ…。

VRChatなどで美少女に受肉する人たちの気持ちが少しわかった。

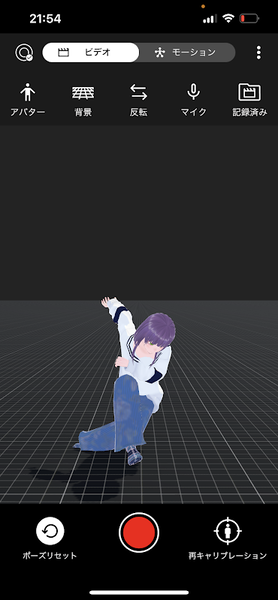

▲動いている様子

「固定する」機能が便利そう

「mocopi」には、腰とカメラの位置をそれぞれ固定する機能がある。

腰の位置を固定する機能を使うと、立ったり座ったりしても固定したままの姿勢にすることができる。

実際の自分は座ったままで、モデルの方は立っている動作をすることができるというわけだ。意外と便利そうな機能。

カメラ位置を固定する機能を使うと、移動してもカメラが付いてこないようにできる。カメラに向かって近づくとアップにできたり、左右に移動したりできる。

映像を撮るには便利そう。

ただ、カメラを固定することはできるのだが、カメラの高さや向きを変えることはできないようだ。

少し上から下を見下ろす画角にしたりしてみたかったのだが……真正面からのカメラ位置にしかできないようだ。

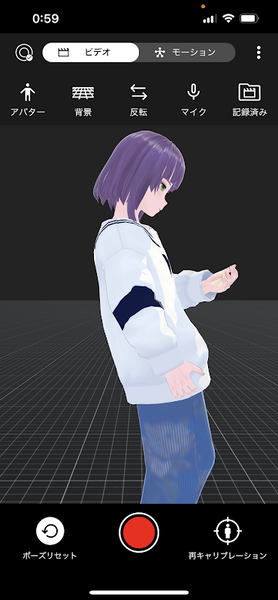

長時間使うと動きがズレてきた……

さらに、使っていると、腕と脚が左右交差してしまうことが結構あるなと気付いた。

ズレを加味して動作をせねばならず、かわいい動作やポーズをするには、モデルの動いている画面を見ながらでないと難しい。

時間と共にズレていくようで、キャリブレーションしてしばらくするとすごく変なポーズになっている。

長時間使うのには向いてなさそう。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

- 第346回 「そこそこ稼ぐおじさん」でいいのか? 迷ったあなたへ

- 第345回 順調なのに不安 その違和感、実は“次のサイン”です

- 第343回 メディアアート再燃?「TOKYO PROTOTYPE」に人が殺到した理由

- 第342回 休職中の同僚を「ずるい」と思ってしまうあなたへ

- 第341回 3Dモデルを必死にリギングした結果、「AIが優秀すぎる」ことに気づいた

- 第340回 VRChatでロボットになりたい筆者、最終的にBlenderを選んだ理由

- 第339回 復職が不安なあなたへ。“戻らない復職”を私が選んだ理由

- 第338回 DJをやってみようと思い立った

- 第337回 「子どもを預けて働く罪悪感が消えない」働く母親の悩みに答えます

- 第336回 ChatGPT、Gemini、Claude──特徴が異なるAI、どう使い分ける?

- この連載の一覧へ