第13回 “あのセキュリティ事故”はどうやったら防げた? 検証委員会

シャドーAIの可視化と利用制御、DLPによる機密情報漏洩防止も可能な「FortiSASE」

病院から患者の個人情報漏洩! “AI世代”研修医が引き起こしたシャドーAI事故……どうやったら防げた?

提供: フォーティネット

■今回のセキュリティ事故:

Y県のベッドタウン、Z市にある市立Z病院は、1960年代の設立から今日まで、長年にわたって地域医療の中核的な役割を担ってきた総合病院だ。中規模ながら多くの診療科を持ち、救急医療にも入院にも対応していることから、Z市民からは「誰もが一度はお世話になるZ病院」と頼られる存在である。

ただし近年、Z病院では医師や看護師、スタッフの人手不足が深刻な課題となっている。Z市の人口は毎年増え続けているが、Z病院の働き手はなかなか増えず、院内のあちこちで“働きすぎ”の状況が見られるようになった。

こうした状況を改善しようと、Z病院では数年前から、DXを通じた労働環境改善の取り組みを進めてきた。まずは電子カルテシステムを中心に据えて患者情報の統合を進め、受付や診察室の呼び出し、会計といった業務の自動化を進めた。この施策は業務効率化に加え、待ち時間を短縮する効果も生み、患者からも好評だ。

これと並行して、医師の業務負荷を軽減するために、生成AI技術を組み込んだ医療文書の作成支援ツールも導入した。これは、他の診療科や他の病院に患者を引き継ぐ際に、電子カルテに記録された患者の情報を要約して伝える医療文書(診療情報提供書=いわゆる“紹介状”、退院時サマリーなど)のドラフトを作成できるツールである。

こうした医療文書は件数が多い一方で、内容に誤りや漏れがないよう専門的な知見に基づくチェックも必須であり、作成にはどうしても時間がかかる。そこで、これまでは若い研修医たちが手作業でドラフト作成業務にあたり、そのドラフトを先輩医師が査読することで、記入ミスを防ぐのと同時に、研修医に対する教育指導の機会としてきた。

だが、人手不足が加速したことで、研修医たちもまた多忙を極めるようになった。そこで、ドラフトの作成を半自動化するツールを導入し、研修医の業務負荷を軽減することにしたわけだ。もちろん、ドラフト作成の責任は引き続き研修医が負うかたちであり、手作業による内容修正や追記も必要なのだが、作成にかかる時間は劇的に短縮された。同時に、電子カルテからの転記ミスも減ったため、研修医も医師も大いに喜んでいた。

そんなときにセキュリティ事故が起こった。研修医の一人が、作成したドラフトのファイルを自分の業務PCにコピーし、業務利用が許可されていない外部の生成AIサービスにアップロードしていたことが発覚したのだ。セキュリティ対策として、電子カルテやドラフト作成ツールのネットワークは外部と隔離されているが、業務PCが接続するネットワークからはインターネットへのアクセスができた。

研修医がアップロードしたドラフトは数人分だけだったものの、そこには患者の氏名や病歴、薬の服用歴といったプライバシー情報が含まれていた。Z病院の内部規定、さらには個人情報保護法や医療法などにも抵触する可能性が濃厚な、重大なコンプライアンス違反である。

さらに問題だったのは、患者の情報がアップロードされた生成AIサービスの利用規約に、「ユーザーが提供した情報は、AIモデルの学習に使用することがある」と明記されていたことだ。つまり、患者の個人情報や病歴といった情報が、このサービスを通じてほかのユーザーに見られてしまう可能性もゼロではないわけだ。

どうしてそのような行為に及んだのか、研修医本人に事情を聞いたところ、自分が作成したドラフトに不備がないか、表現は正しいかといった点を、査読してもらう前に確認しておきたかったのだと説明した。これまで何度か先輩医師にドラフトを提出したが、そのたびに多数の記入ミスや表現の誤りを指摘され、自信を失っていたのだという。「これ以上、忙しい先輩に迷惑をかけるわけにもいかないと思い、軽率なことをしてしまいました……」と、研修医はわびた。

Z病院では、患者に謝罪するのと同時に、研修医全員に対して緊急でコンプライアンス研修を行い、事故の再発防止に努める方針だ。

だが、“AI世代”の若い研修医たちの間では、プライベートでも業務でも生成AIサービスが日常的に使われ始めている。その一方、そうしたサービスで入力した情報がどう扱われるのかを、深く理解している者は少ない。これから上の世代にもAIサービスが普及すれば、同じような事故が繰り返されるおそれがある。……このセキュリティ事故は、どうやったら防げたのだろうか?

※このストーリーはフィクションです。実在する組織や人物とは関係ありません。

医療機関におけるDXと生成AIの活用、患者のプライバシーをめぐる課題

近年、国を挙げた取り組みとして、医師や看護師、その他の医療スタッフの長時間労働を是正する「医療現場の働き方改革」が進められている。この取り組みによって、医療現場の働き手の健康やワークライフバランスを守ることは、患者に対する医療の質や安全を守ることにもつながる。

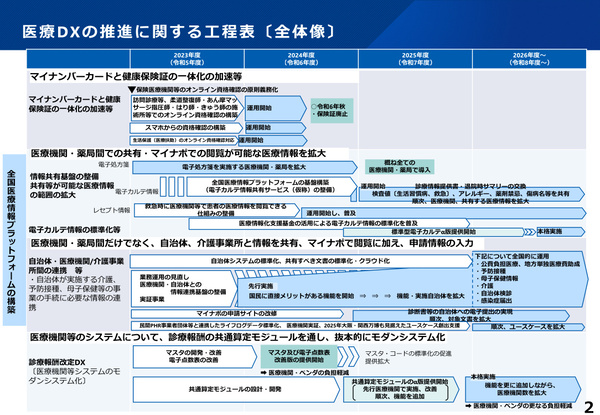

医療現場で働き方改革を進めるための、具体的な施策のひとつが「医療DX」だ。IT、AI、ロボットなどのデジタル技術を活用し、医療現場での業務効率化や自動化を促進することで、医療の質や安全を確保しながら労働時間の削減につなげていく。クラウド型電子カルテシステム、オンライン診療(遠隔医療)、AIによる診断補助など、幅広い領域で一斉にデジタル化が推進されている。

医療DXは、医療現場の働き方改革だけでなく、医療機関の間での迅速な医療情報の共有なども目標に進められている(出典:厚生労働省)

今回の事故事例で取り上げた、医療文書の作成支援システムもそのひとつである。これまでは研修医や医師が手作業で作成していた医療文書を、生成AIが電子カルテの情報に基づいて自動で生成する。もちろん、自動生成された文書は「ドラフト(下書き)」という扱いであり、文書の完成には医師のチェックと加筆修正が必要だが、業務負担の軽減と業務のスピード化につながるのは間違いない。

ただし、このシステムが取り扱うのは、患者の個人情報や病歴、アレルギー情報といったプライバシーに関わる情報であり、情報の取り扱いには最大限の慎重さが求められる。そのため、こうした医療機関専用のシステムでは、入力された患者情報を生成AIの学習に使うことはない。また、厚生労働省や個人情報保護委員会でも各種ガイドラインを定めており、システムを開発/提供する側にも、それを利用する側の医療機関にも、プライバシー保護に十分配慮することが求められている。

医療DXの推進と同時に、患者のプライバシー保護を実現するための各種ガイドラインが発行されている(出典:厚生労働省)

その一方で、インターネットで公開されている汎用の生成AIサービスには、入力された情報をそのまま学習に用いるものもある。

通常、利用規約にはその旨が明記されているのだが、今回取り上げた研修医のように、それを理解せず利用しているユーザーも多い。さらに、情報漏洩のリスクは理解していても、AIサービスを日常的に利用するうちに「ついうっかり」個人情報や機密情報を書き込んでしまう事故もあるだろう。

「一律禁止」ではなく、生成AIを「安心して、適切に使える」環境が必要

いわゆる“シャドーAI”(無許可でのAIサービスの使用)の問題は、今回取り上げたような医療機関に限った話ではない。これからAIサービスの利用が広く普及していけば、一般企業でも官公庁/自治体でも、必ず発生する問題だと考えておいたほうがよいはずだ。

生成AIサービスの登場以降、多くの組織で「シャドーAIの一律禁止」ルールが策定された。しかし今後、生成AI技術が急速に進化して利便性が高まり、個々人の業務効率化や仕事の質の向上にも貢献するようになれば、ルールが有名無実化するおそれもある。

これから必要なのは、AIサービスを一律に禁止することではなく、むしろ「安心して、適切にAIサービスが活用できる環境」を用意するという、前向きな解決策ではないだろうか。そして、そうした環境を実現するためには、組織内の個々人が理解しやすいシンプルなルールやガイドラインの策定に加えて、技術的な安全策、いわゆる“ガードレール”の構築も必要になる。

具体的な技術対策としては、大まかに次のようなものになるだろう。

・“シャドーAI”も含め、組織内でのAIサービスの利用状況を詳しく可視化する

・一律の禁止ではなく、AIサービスごと、ユーザーごとに許可/禁止する

・入力/アップロードする情報の内容に基づき制御(ブロック)する

・細かな操作内容、入力した情報までを記録し、監査に対応する

“シャドーAI”を可視化し、プライバシー情報の漏洩を防ぐ「FortiSASE」

シャドーAI問題について、こうした技術的対策を可能にするのが、フォーティネットの「FortiSASE」である。組織からのインターネットやクラウドサービスへのアクセストラフィックを監視し、包括的なセキュリティ対策を適用するサービス(SASE)だ。

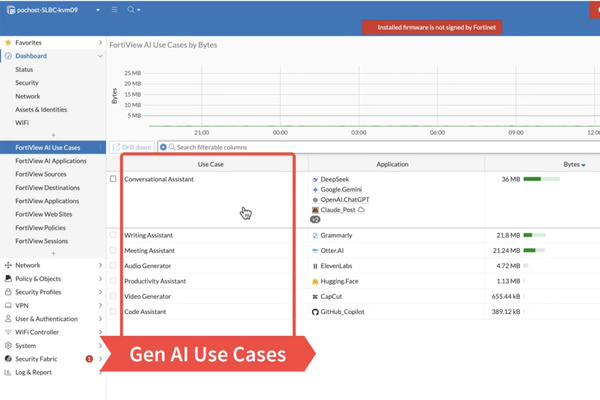

まず、AIサービス利用状況の可視化や、サービス/ユーザーごとの利用制御、ログ記録については、FortiSASEに「FortiAI-Protect」を組み合わせることで実現できる。

FortiAI-Protectは、AIがもたらす脅威からの防御を目的とした機能群であり、ここに「シャドーAIの検知と制御」機能も含まれる。FortiSASEと組み合わせることで、AI/生成AIサービスに関連する6500以上のURLへのアクセスを検出し、制御できる。以前の記事で紹介したので、詳しい説明はそちらを参照いただきたい(関連記事:広告制作で無許可の“シャドーAI”利用、発表前の商品情報が漏洩! どうやったら防げた?)。

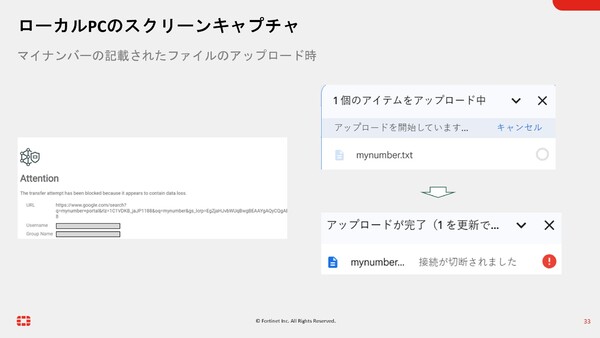

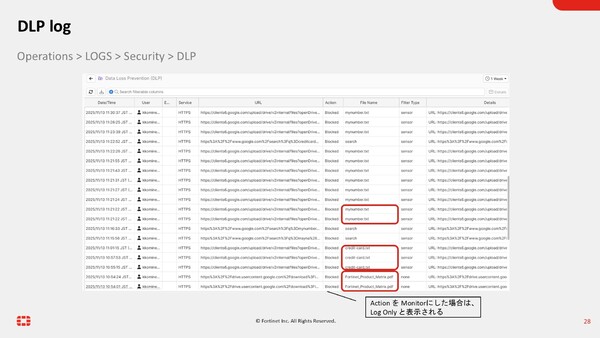

一方、アップロード/入力した情報の内容に基づく制御(ブロック)については、FortiSASEのDLP機能を使うのが有効である。DLPは「Data Loss Prevention(情報漏洩防止)」を意味する言葉だ。

FortiSASEのDLP機能では、さまざまな機密データの“パターン”を定義し、送受信されるトラフィックがそのパターンに一致した場合に、通信をブロックして警告を表示したり、通信はそのまま許可しつつログに記録したりする制御が行える。

検知対象とする機密データのパターンは、よく利用される主要なもの(クレジットカード番号、マイナンバー、保険証番号など)があらかじめ辞書として定義/提供されているほか、その辞書をカスタマイズしたり、キーワードや正規表現、バイナリ文字列の組み合わせで自ら定義したりすることもできる。また、Webアクセスだけでなく、メールやFTPなどのトラフィックも検査可能だ。

さらに、こうした通信制御は、ユーザー/グループごとにポリシーを適用できる。したがって、職務上で機密情報の取り扱いが必要なユーザーにのみ、そうした通信を許可するようなポリシー設定もできる。

こうした仕組みを今回の事故に当てはめて考えると、患者のプライバシー情報が含まれるファイルをアップロードしようとした段階で、通信を強制的にブロックし、ログ記録したうえで管理者に通知する――といった流れで、情報漏洩を未然に防げたはずだ。

また、米国の医療情報保護法であるHIPAAをはじめ、クレジットカード情報保護のPCI-DSS、欧州のGDPR、米国のCCPAといった情報保護規制への準拠を支援するほか、その準拠状況をコンプライアンスレポートとして出力することもできる。こうした機能を活用すれば、コンプライアンス状況の継続的な監視と改善にもつながる。

■セキュリティ事故、その後日談:

事故発生後、Z病院では今後の事故防止策を検討し、あらためて院内における生成AIサービスの利用ルールを策定し直すことにした。その準備作業として、FortiSASEを導入して現状の生成AIサービスの利用状況を可視化する。ひとまずは、利用されているもののうち、リスクが低く、業務効率化に役立つと考えられるものだけを許可する方針だ。もっとも、生成AIサービスは日々進化しているので、新たなサービスの利用が必要になればそのつど許可するかどうかを検討していく。

さらに、生成AIサービスへの情報漏洩事故を防ぐガードレールとして、FortiSASEのDLPも適用することにした。ここでは、病名や薬品名のみが入力された場合はログ記録だけにとどめるが、患者が特定できる個人情報と組み合わせて入力された場合はブロックする、といったポリシーにしていく。医師や看護師、医療スタッフが、患者のプライバシーを守りつつ、安心して生成AIサービスやITツールを使える環境を整えることで、院内DXを積極的に進めていくのが目標だ。

この連載の記事

- 第14回

sponsored

化学メーカーの研究データが漏洩! 脆弱性診断が見落としたVPN装置… どうやったら防げた? - 第12回

sponsored

工場内からサイバー攻撃発生、しかし攻撃元が見つからない! ……どうやったら防げた? - 第11回

sponsored

工場の“サポート切れOSパソコン”がランサムウェアの感染源に! ……どうやったら防げた? - 第10回

sponsored

広告制作で無許可の“シャドーAI”利用、発表前の商品情報が漏洩! どうやったら防げた? - 第9回

sponsored

建設現場で協力会社のPCがランサムウェア感染、工事がストップ! どうやったら防げた? - 第8回

sponsored

ニセ広告にだまされ社員のPCがランサムウェア感染! どうやったら防げた? - 第7回

sponsored

社員の“シャドーAI”利用で、取引先の情報が漏洩! どうやったら防げた? - 第6回

sponsored

95Gbpsの大規模DDoS攻撃で、予約サイトがサービス停止に! どうやったら防げた? - 第5回

sponsored

クラウドのサービス開発で健康データ4万件が漏洩の危機! どうやったら防げた? - 第4回

sponsored

EDRが発したアラートへの対応が遅れ、100GB超の情報漏洩! どうやったら防げた?

この記事の編集者は以下の記事もオススメしています

-

sponsored

サイバー攻撃もAIで進化!? フォーティネット、クラウド内のAIセキュリティを強化へ -

sponsored

社員の“シャドーAI”利用で、取引先の情報が漏洩! どうやったら防げた? -

TECH

フォーティネット「FortiDLP」発表、シャドーAIやインサイダー対策などを単一のDLPで -

sponsored

デザインと信頼性を両立。フォーティネットの「FortiGate Ruggedシリーズ」がレッド・ドット賞を2年連続受賞 -

sponsored

オンプレミスからクラウドまでシームレスに防御 「FortiGuard SOCaaS」でハイブリッド環境に対応 -

sponsored

ホリデーシーズンを狙うサイバー犯罪に注意! -

sponsored

一見無害な文書が侵入口に。中東周辺で確認されたサイバー攻撃の手口