AIは時々、もっともらしいウソをつく ハルシネーションを見破りファクトチェックする4つの方法

2025年09月26日 09時00分更新

本連載は生成AIをこれから活用しようとしている方たちのために、生成AIの基本やコピペしてそのまま使えるプロンプトなどを紹介。兎にも角にも生成AIに触り始めることで、AIに対する理解を深め、AIスキルを身に着けて欲しい。第29回はAIの出力で見られるハルシネーションと、簡単にファクトチェックができる方法について解説する。

AIを使う上でもっとも注意しなければならないハルシネーション

ChatGPTやGeminiをビジネスで活用する人が増えてきた。リサーチや資料作成の時間が劇的に短縮されて、もうAIなしの仕事は考えられない!と感じている人も多いのではないだろうか。SNSでは「AIに頼んだら、業界レポートが一瞬で完成した!」や「企画のアイデア出し、無限に出てきて最高!」といった投稿も見かける。

しかし、生成AIを活用するにあたり、絶対に見逃してはいけないことがある。そのAIが作ったレポートや企画書を100%信じて、そのまま上司や取引先に出していないだろうか? もしそうなら、気づかないうちに大きなビジネスリスクを抱えているかもしれないので注意が必要だ。

AIは時々、もっともらしいウソをつく。この現象は「ハルシネーション(幻覚)」と呼ばれていて、AIを仕事で使う上でもっとも気をつけなければいけない落とし穴となっている。

生成AIは、超高性能な文章の予測変換マシーンのようなもの。本当の意味で何かを知っているわけではなく、インターネット上にある膨大な文章を学習して、「この単語の次には、この単語が来る確率が高い」というパターンを計算して、それっぽい文章を作っているのだ。例えるなら、知識は豊富で空気も読めるが、時々知らないことを知ったかぶりして、もっともらしい話を作ってしまう新人アシスタントのようなものだ。

レポート作成時によくある失敗として、参考文献が全部ニセモノだったというケースがある。AIに「参考にしたサイトのURLを教えて」と頼むと、いかにもそれらしいURLの一覧を出してくれるのだが、リンク先が開かないということも多い。参考文献を検索しても存在しないということもある。

法律を調べてみると、架空の判例が出てくることもある。実際にアメリカでは、弁護士がAIの作ったハルシネーションの判例を裁判所に提出してしまい、大問題になった。

ファクトチェックする4つの方法

ビジネスで生成AIを活用するなら、必ずハルシネーション対策をすること。ハルシネーションを起こしにくくするプロンプトや発生しにくいAIを使うのもありなのだが、最終的には必ずファクトチェックする必要がある。今回は、簡単にファクトチェックする方法を4つ紹介する。

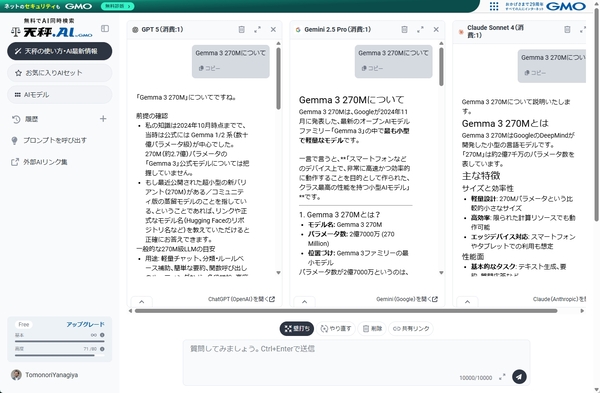

1つ目が、複数の生成AIを利用すること。ChatGPTとGemini、Claudeといった御三家に加え、PerplexityやFeloといった検索特化型生成AIを組み合わせて、同じプロンプトを入力するのだ。そして、複数の生成AIの出力に出てきている情報を採用するとハルシネーションを除去できる可能性が高まる。

ただし、この方法は万全とは言えない。本当にミスが許されない文書に利用する場合は、他のチェックも併用しよう。

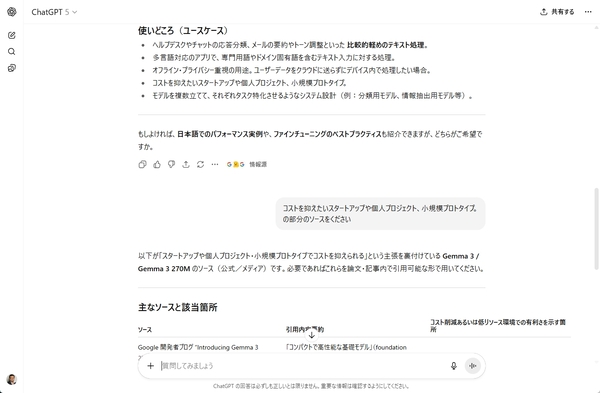

2つ目は、ファクトチェックしたい内容について、「その情報の出典(ソース)は?」と追加で質問すること。ソースがない時は素直に謝り、再出力することも多い。ソースが提示されたら、調べてみよう。URLが開けなかったり、論文が存在しなければハルシネーションということだ。

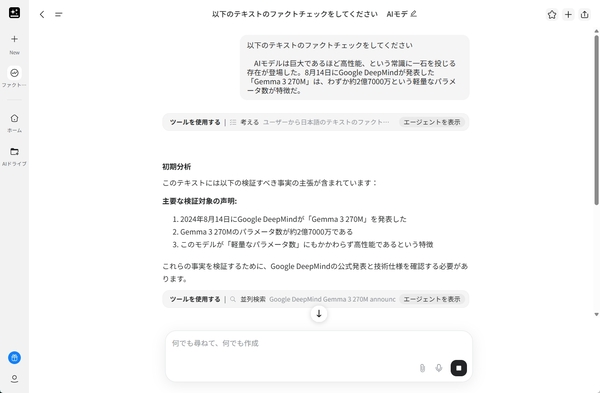

3つ目が、生成AIでファクトチェックすること。とはいえ、長い原稿をまるごとファクトチェックしようとすると漏れが出るので、段落単位でチェックするといい。プロンプトは「ファクトチェックして」でOK。その際は、別セッションで、できれば異なる生成AIサービスでチェックするといい。同じセッションだと、文脈を引き継いで問題なし、と回答する可能性が高まるからだ。

4つ目が、固有名詞と数字をGoogleで検索すること。ハルシネーションで一番問題になるのが、「人名、会社名、事件名」などの固有名詞と、「統計データ、日付、金額」などの数字の間違いだ。生成AIの回答にこれらの情報が出てきたら、反射的にGoogle検索する癖をつけておこう。

出力のどの部分を怪しいと感じるかは、その人のビジネススキルによる。新人ほど、ファクトチェックを厳重にすることをお勧めする。研究によると、ビジネススキルの高い人ほど生成AIの出力を批判的な目で見てチェックし、ビジネススキルの低い人ほどチェックせず信じてしまう傾向にあるので注意すること。

複数AIを利用し、ソースを提示させ、AIにファクトチェックさせる。そして最後に、ググる習慣を身につければ、ハルシネーションのリスクを最低限に抑えられる。AIのクセを理解し、その力を安全に引き出すことこそが、これからの時代に「仕事がデキる人」の条件となるだろう。

AIで何とかしたい業務を大募集!

「簡単すぎて驚く生成AIの使い方」で取り上げてほしいAIの使い方を大募集。「この作業をAIで時短したい」「こういうことがしたいけどプロンプトはどう書けばいい?」など、お困りのことを解決します。

応募はハッシュタグ「 #ASCIIAI連載ネタ 」を付けてXでポストするだけ。ハッシュタグ「 #ASCIIAI連載ネタ 」がついたポストは編集部で随時チェックし、連載記事で取り上げます。高度な内容である必要はないのでお気軽にどんどんポストしてください。

注目の最新AIニュース

ChatGPT利用実態、7億人のデータ分析で判明。7割超がプライベート目的へ劇的シフト

全米経済研究所(NBER)がOpenAIの内部データを分析し、ChatGPTの利用実態を明らかにした。2025年7月時点で週間ユーザーは7億人を突破し、ジェンダーギャップも解消されるなど、世界的な生活インフラへと変貌している。利用目的が変化しているのだ。仕事の効率化ツールという初期のイメージとは異なり、プライベートでの利用が全メッセージの73%に急増した。AIが仕事だけでなく家庭での学習や趣味にも大きな影響を与えていることがわかる。また、タスクを直接実行させるよりも、情報や助言を求める利用が多く、満足度も高い。特に専門職は、AIを意思決定を支援する「コパイロット」として活用しており、単なる作業代行者ではない新たな役割が広がっているとのことだ。

この連載の記事

-

第50回

Team Leaders

AIのウソはどう見抜く? 課金すべき? 人気記事トップ3で振り返る「生成AI活用術」 -

第49回

Team Leaders

ChatGPTに役割を与えたグループチャットでビジネスアイデア出しを加速させる -

第48回

Team Leaders

スマホからChatGPTをバリバリ使い倒す! スキマ時間が有効に活用できるChatGPTスマホアプリ -

第47回

Team Leaders

プロンプトのコピペはもう古い。自分専用AI「Gem」でチームの生産性を爆上げせよ -

第46回

Team Leaders

以前の指示をすぐ忘れるChatGPT あらかじめ必要なデータを登録しておく「プロジェクト」機能活用で手間を省こう -

第45回

Team Leaders

通勤時間やスキマ時間を事前学習時間として有効活用! NotebookLM音声解説機能のおすすめプロンプト -

第44回

Team Leaders

「使えない」とあきらめない、NotebookLM作成スライドを実務レベルに引き上げる3つの秘策 -

第43回

Team Leaders

社内向けスライドはNotebookLMにおまかせ! ファイルやURLを登録するだけで時間を溶かさない! -

第41回

Team Leaders

2026年からでも間に合う! ChatGPTやGeminiの有料プランをお勧めする理由 -

第40回

Team Leaders

2025年激動の生成AIシーンを振り返る! AIエージェント元年を経て2026年はどう進化するのか!? -

第39回

Team Leaders

素早く信頼性の高い検索やファクトチェックをするならChatGPTやGeminiよりPerplexityがオススメ - この連載の一覧へ