AIの大まかな話は前回説明した通りだが、もう少し細かく「なにをやっているか」を今回説明したい。

やや古い話であるが、GTC 2015においてFacebookのRob Fergus氏が“Visual Object Recognition Using Deep Convolutional Neural Networks”というトレーニングコースを実施しており、現在もGTC オンデマンドで視聴できる。

25分ほどの短いセッションで、英語も平易なのでわかりやすいが、こちらのスライドをもとに、そもそもConvolutional Neural Networkではどんな計算処理が必要かを細かく説明していこう。

コンピューターに文字や画像を認識させる

畳み込みニューラルネットワーク

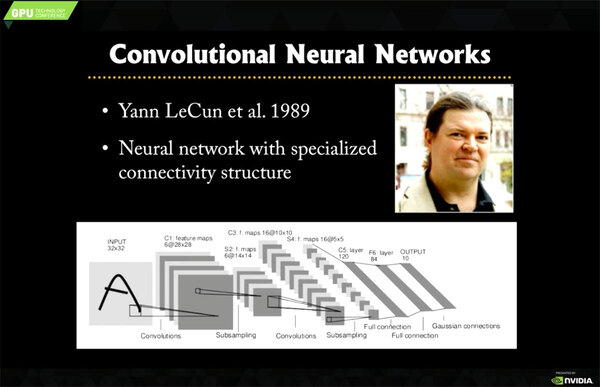

そもそも畳み込みを使うConvolutional Neural Networkを最初に提唱したのは、Facebookに在籍しているYann LeCun氏らによる“Backpropagation Applied to Handwritten Zip Code Recognition”という1989年の論文である。

これは手書きの郵便番号を認識するシステムで、0~9の数字が認識できればいいわけだが、これの認識に下の画像の下側のようなネットワークを考案した。

このネットワークは学習の完了後に1%程度のエラー率で手書きの数字を認識でき、またAT&TのDSP-32Cという汎用DSP(性能はピークで25MFlops)に実装したところ、毎秒30回の認識できたとする。アメリカの場合は郵便番号が5桁なので、つまり毎秒6つの郵便番号を認識できることになる。

前回紹介したAlexNetに比べるとだいぶシンプルではあるが、10種類の文字の認識程度であればこれでも十分、という話である。

LeCun氏のネットワークの場合、まず畳み込みを2回繰り返し、その後で3層の全結合が行なわれる。意味合い的には、最初の2層の畳み込み層で、入力画像をいわば部品に分解、続く3層でその部品の結果を組み合わせて最終的な判断をする形になる。

画像を調べて特徴を抽出する

「畳み込み」

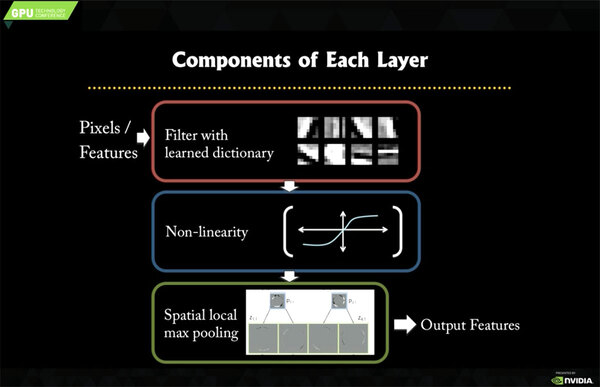

そこでまずは畳み込み層の説明をしよう。ここは畳み込み→非線形関数→サブサンプリングという3つの作業からなる。

さてその畳み込み、確か高校までの数学には出てこなかった「気がする」(なにしろ高校卒業なんてもう40年近く前なので……)。おそらく大学の教養課程の数学で学んだか、物理数学の時間だったかもしれないと思うのだが。

数学的に言えば、2つの関数の重ね合わせのことを畳み込みと表現する。ただここで数式を並べても意味がないので実例で説明したい。

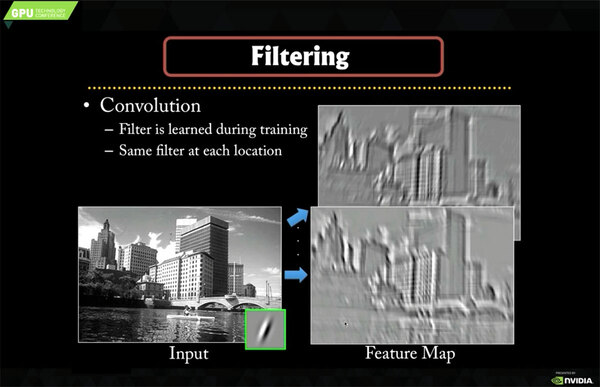

下の画像は、入力画像(左側)とフィルター(Inputの右下:Kernelとも呼ばれる)の畳み込みを行なった出力(Feature Map)を示したものだ。

ここでどんな処理をしているかというのが下図である。要するに左上から右下まで、フィルターの位置を少しずつずらしながら、入力画像とフィルターを重ね合わせ、合計値をFeature Mapとして出力する形になる。

図の例で言えば、Feature Mapの1ピクセルを出力するのに乗算と加算がそれぞれ9回必要になるので、1枚(図の例なら6×6pixel)を生成するのに324回の乗算と加算が必要になる計算だ(*1)。

(*1) ここの例ではFeature Mapのサイズを入力画像より小さい6×6にしているが、精度を上げるために同じ8×8にするといったことも当然可能である。この場合は計算回数が576回に増えることになる。

ちなみにフィルターは1種類ではない。したがって、複数のフィルターを掛け、複数のFeature Mapを生成する必要がある。

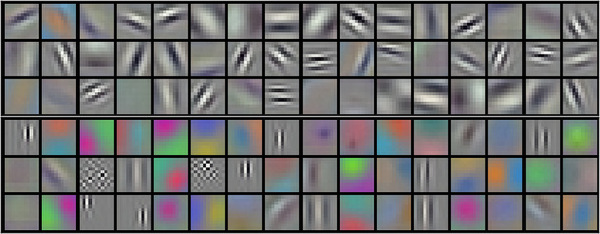

下の画像は2012年のAlexNetで利用されたもので、合計96種類のフィルターが利用された。

- 入力画像は224×224pixel×24bit(RGB)

- フィルターは11×11pixel×24bit(RGB)

このAlexNetの場合、1枚のFeature Mapを生成するのに必要な計算数は1662万3948回。しかもフィルターは96種類あるので、15億9589万9008回の乗算と加算が必要ということになる。

もうこのあたりで、だいぶ桁が大きくなっている。ちなみにこれはあくまで1層分である。冒頭のLeCun氏のネットワークでも畳み込みは2層、AlexNetでは5層もあるので、それは計算量が多いわけだ。

この連載の記事

-

第769回

PC

HDDのコントローラーとI/Fを一体化して爆発的に普及したIDE 消え去ったI/F史 -

第768回

PC

AIアクセラレーター「Gaudi 3」の性能は前世代の2~4倍 インテル CPUロードマップ -

第767回

PC

Lunar LakeはWindows 12の要件である40TOPSを超えるNPU性能 インテル CPUロードマップ -

第766回

デジタル

Instinct MI300のI/OダイはXCDとCCDのどちらにも搭載できる驚きの構造 AMD GPUロードマップ -

第765回

PC

GB200 Grace Blackwell SuperchipのTDPは1200W NVIDIA GPUロードマップ -

第764回

PC

B100は1ダイあたりの性能がH100を下回るがAI性能はH100の5倍 NVIDIA GPUロードマップ -

第763回

PC

FDD/HDDをつなぐため急速に普及したSASI 消え去ったI/F史 -

第762回

PC

測定器やFDDなどどんな機器も接続できたGPIB 消え去ったI/F史 -

第761回

PC

Intel 14Aの量産は2年遅れの2028年? 半導体生産2位を目指すインテル インテル CPUロードマップ -

第760回

PC

14nmを再構築したIntel 12が2027年に登場すればおもしろいことになりそう インテル CPUロードマップ -

第759回

PC

プリンター接続で業界標準になったセントロニクスI/F 消え去ったI/F史 - この連載の一覧へ