全盲の人でも街を歩き、知り合いを見つけ、商品を手にとって商品名や説明を読み、本を読める

視覚障害者用ウェアラブルデバイス「ホルス」、2016年内に出荷開始

2016年11月02日 18時25分更新

米NVIDIAは10月27日、同社ブログにおいて視覚障害者向けウェアラブルデバイス「Horus(ホルス)」が年内に出荷開始されると伝えた。

Horusはスイスのベンチャーが開発したウェアラブルデバイス。人工知能(ディープラーニング技術)が使用されており、2016年4月のNVIDIA主催による新興企業サミットにおいて、Horusデバイスおよび搭載する人工知能技術開発は最有望のスタートアップとして選ばれており、本体プロセッサーとしてNVIDIA Tegra K1を採用するなど製品化にはNVIDIAが大きく携わっている。

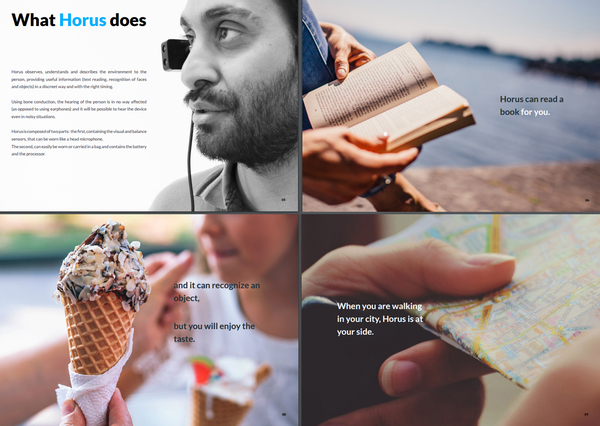

Horusはイヤフォンと2つの小型カメラを備えるヘッドセットと、ベルトなどに装着するスマホサイズの本体で構成。本体には画像処理を含むディープラーニング技術が組み込まれ、カメラが撮影した画像を人工知能エンジンが解釈、ユーザーである視覚障害者に向けてイヤフォンで各種の音声アドバイスを行なう。

非常に強力な画像認識を持つとしており、歩行サポートではナビゲーション機能に加えて進行方向に障害物があれば通知し、人がいれば顔認識して(知人であれば)誰かを伝える。目の前にある物品が「何」であるか、目の前に広がるのが「どのような風景」なのかも音声で解説、さらには手に取った物品に印刷されている文字を読み、もちろん本を読むこともできる。

Horus搭載のディープラーニング技術はEyra(Horus同様にスイスのベンチャー企業)が開発しており、モバイルデバイスに搭載するものとしては非常に強力だと考えられる。さらにNVIDIAでは、NVIDIA Tegra K1のグラフィック性能を活かした画像認識、192個コアGPUによる並列演算、さらにディープラーニング開発環境NVIDIA CUDAが大きく貢献したとしている。

Horusは2016年1月からの早期ユーザーによる実証試験を受けて各種改善が施され、製品版は2016年後半からリリースが始まるとしている(サポート言語は英語および日本語)。価格は2000ドル前後を見込んでいる。