ネイキッドとエイベックスが開発、デジタルアート展「FLOWERS BY NAKED」でパフォーマンスを披露

観客の感情をAzure AIが解析、音楽や映像を即興で生成「HUMANOID DJ」

2020年02月18日 07時00分更新

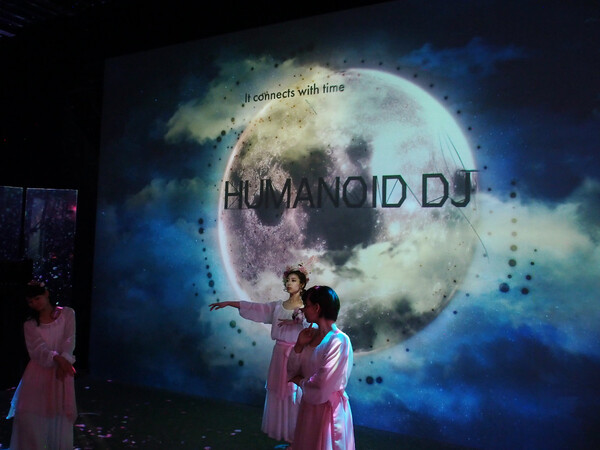

東京・日本橋三井ホールで開催中の「FLOWERS BY NAKED 2020 -桜-」(主催:FLOWERS BY NAKED製作委員会)では、クリエイティブカンパニー ネイキッドとエイベックス・エンタテインメント(avex)が共同開発する「HUMANOID DJ」と、人間のダンサーチームがコラボレーションするライブパフォーマンス「LIVE BY HUMANOID DJ 花宴」が展開されている。

このパフォーマンスでは、会場にいる観客の年代や性別、人数、さらに「感情」を解析し、即興でその状況に合わせた楽曲と映像演出が披露される。つまり32日間の会期中、およそ600回に及ぶパフォーマンスは「毎回異なる内容」となる。そしてそのバックエンドには、マイクロソフトのAIサービスである「Azure Cognitive Services」が用いられているという。会場で取材した。

「いろいろな人、場所、モノと“Connect”して新しい音楽体験を作る」

FLOWERS BY NAKEDは、「五感で巡る体感型庭園」をテーマとしてネイキッドが演出を手がける、体験型のデジタルアートイベントだ。東京・日本橋での開催は5年目となるほか、これまで京都・二条城や香港でも開催され、通算で50万人以上を動員してきたという。

「FLOWERS」というタイトルや「日本一早いお花見」というキャッチコピーのとおり、会場内は生花、アーティフィシャルフラワー、プリザーブドフラワー、花のオブジェ、さらには壁面から床面までのプロジェクションマッピング映像、音楽、数種類の香り(アロマ)などで彩られている。観客は9つ用意された“秘密の庭園(ガーデン)”の中を、各種センシング技術やARアプリを使ったインタラクションも楽しみながら散策するという趣向だ。

HUMANOID DJと「春の精霊」ダンサーによるパフォーマンスは、会場内の「OUSAI Garden」エリアで30分ごとに披露されている。現在の「お花見」の原型となった、歌と舞いで花を愛でる宴のスタイルを最新のテクノロジーを活用して表現する、およそ3分半のパフォーマンスだ。

HUMANOID DJの開発プロジェクトは、昨年(2019年)のFLOWERS BY NAKEDからスタートしたものだ。「観客の感情を解析し、機械、データ、ネットワークとも繋がり、姿形や空間自体も変容させ、その瞬間、その空間でしか体験できない音楽を創り出す」(公式サイトより)というコンセプトで、これまでも登場するイベントごとに、その場に応じた演出と機能を追加しながら進化させてきたという。

「HUMANOID DJは『Connect』がテーマで、いろいろな人、場所、モノと融合することで、新しい音楽体験を目指していこうというプロジェクトです。今回はダンサーとのコラボレーションという形ですが、たとえばソロアーティストとして出演した昨年9月のフェス(幕張メッセで開催された「DIVE XR FESTIVAL」)では、お客さんの“参加型ライブ”を目指しました。具体的には、盛り上げたいタイミングでHUMANOID DJがスクリーンに『Hands Up!!』といったメッセージを出し、お客さんに手を振ってもらうような演出です」(ネイキッド プロデューサーの神崎沙耶香氏)

「HUMANOID DJは日々進化していると、われわれ自身が一番実感しているところです。昨年のFLOWERSではまだ原始的なことしかできませんでしたが、海外イベントやフェスでの出演など、回を重ねるごとに新たな演出を取り入れ、その幅も広がってきました。ある意味で『より人間の手数に近づいている』と思います。引き続き用途を拡大しながら、パフォーマンスを追求していきたいと考えています」(エイベックス 新事業推進本部 デジタルクリエイティヴグループ ゼネラルマネージャーの山田真一氏)

Azure Cognitive ServicesやAzure IoT Hub/Edgeをバックエンドに採用

今回のFLOWERS BY NAKED 2020で投入されたバージョンのHUMANOID DJは、前述したとおり、会場にいる観客を多面的にデータ解析して、即興で楽曲を生成する。同時に、ダンサーの背後や足下に投影されるCG映像も、ダンサーの動きや観客のデータに応じて変化するという。

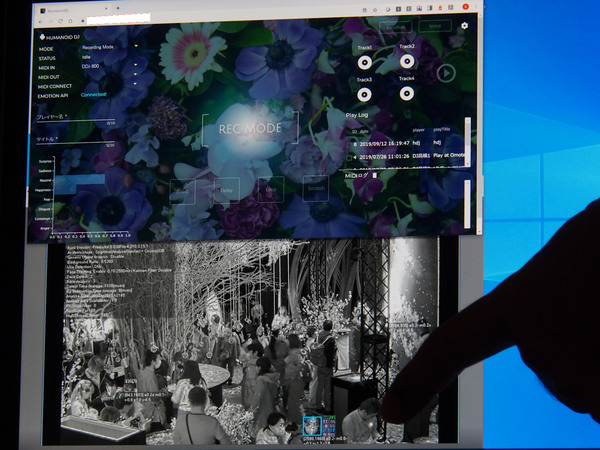

まず音楽の仕組みから見てみたい。ここではAzure Cognitive ServicesのFace(顔認識)機能を使い、パフォーマンス会場に設置されたカメラ映像から、観客のデータを解析する。具体的には、年代、性別、人数、表情から読み取れる感情(喜び、驚き、悲しみ、怒りなど8種類)を解析している。なおマイクロソフトの説明によると、今回は「Azure IoT Edge」を用いてコンテナ化したCognitive Servicesモジュールを、ローカル環境のPC上で動かしているという。

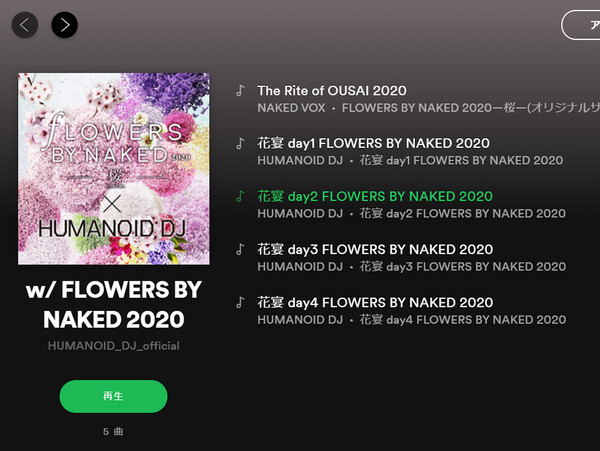

HUMANOID DJシステムはこのパラメーターをAPI経由で取得し、DJコントローラー(人間のDJも使用する一般的な製品)を制御するかたちで、即興で楽曲を生成する。ネイキッドのサウンドチーム「NAKED VOX」が制作した3分半のオリジナル曲「The Rite of OUSAI 2020」をベースに、同じ曲で声や楽器の種類を変えた複数のトラックが用意されており、パラメーターに応じてミックスやトラックの変更、エフェクトの適用を行う仕組みだ。

なお、オリジナルの曲とHUMANOID DJが即興で構成した曲は、オンラインでも公開されている。これらを聞き比べると、HUMANOID DJが何をやっているのかがよくわかるはずだ。

映像演出もHUMANOID DJの一部だ。今回は、メインダンサーが腕につけたセンサーの動きをトラッキングして軌跡を描き“羽衣”を表現しているほか、ダンサーの足下に波紋や花びらなどを投影する。またクライマックスシーンの桜は、観客のデータに応じて色や形が変化する。これらは「Azure IoT Hub」を介して処理されているという。

なおFLOWERS BY NAKED 2020 -桜-は3月1日まで開催されている。