機械学習のパフォーマンスを向上させる新サービス投入

Night Liveもラスト30分になり、機械学習(ML:Machine Learning)について説明したのが、スペシャリストであるDr.マット・ウッド氏だ。

AWS AI部門GM マット・ウッド氏

ウッド氏は、今でこそ多くのアクティブユーザーが利用している機械学習だが、以前は資金のある研究機関しかできなかったと指摘。「学術機関と提携し、資金を得て、提案書を書いて、請求書を受け取っていた。その後、ベンダーからのハードウェアを待ち、スタックや配線し、設定してからHPCクラスターを利用することになる」とウッド氏は語る。よりよりモデル、より優れたアルゴリズムを探すためには、こうしたプロセスを何度も行わなければならなかった。つまり、機械学習で成果を得るまでのパフォーマンスがきわめて悪かったわけだ。

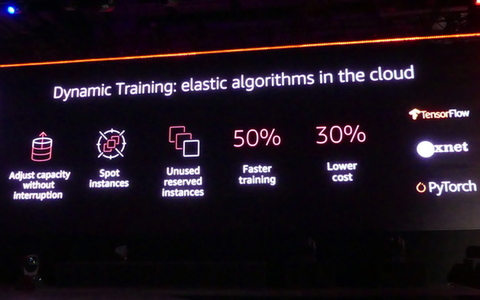

ウッド氏は、AWSでも機械学習のパフォーマンスを向上させるには多くのデータを効率的に集め、よりよいアルゴリズムに載せ、高速なコンピュートで動かすことが必要になると指摘。その点、AWSではS3からGPUに直接データをロードするパイプモードによりスループットを改善することが可能になっているほか、複数のフレームワークやインターフェイスをサポートしているという。そして、今回新たにトレーニング用のクラスターのキャパシティを動的に調整できる「Dynamic Training」が発表された。コスト効果の高いスポットインスタンスやリザーブドインスタンスを割り当てることで、安価で高速にトレーニングを実施できるという。当初はmxnetの対応のみだが、TensorFlow、PyTorchなどもサポートされるという。

柔軟なキャパシティ変更が可能なDynamic Training

また、クラウド上で最強を謳うGPUインスタンスとして「P3dnインスタンス」が発表された。最新のNVIDIA Volta V100が搭載し、GPUあたり32GBのメモリ、96のvCPUが利用可能。100Gbpsのネットワークや2TBのNVMeもサポートされている。

さらにディープラーニング用のモデルコンパイラーである「Amazon SageMaker Neo」も発表された。昨年発表された機械学習用のプラットフォームであるSageMakerで生成したモデルをAmazon SageMaker Neoに導入すると、特定のハードウェアプラットフォーム向けにコンパイルし、パフォーマンスも改善してくれるという。おもにエッジコンピューティングにおける機械学習の利用を想定しており、インテル、クアルコム、Arm、NVIDIA、ケイデンス、ザイリンクスなどハードウェアベンダーとの協業を進めているという。あわせてSage Maker Neoのオープンソース化も発表された。

ハードウェアに特化したモデルのコンパイルを実現するAmazon SageMaker Neo

コンテナ環境でのセキュリティを確保するFirecracker

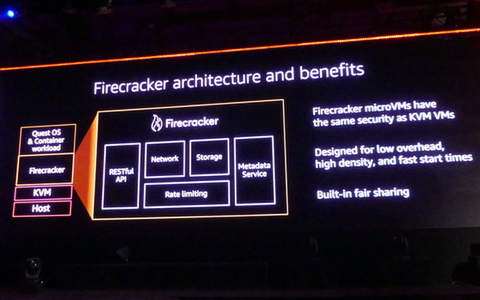

最後、壇上に戻ってきたデサントス氏は、サーバーレスコンピューティングのための新しい仮想化技術として「Firecracker」を発表した。Firecrackerでは、非仮想化環境上でマイクロVMを起動できるサービスで、既存のKVMと同じ隔離を実現し、セキュリティを確保する。5MBメモリしか消費しないマイクロVMということで、起動も高速で、1秒あたり150のマイクロVMを起動できる。

軽量なマイクロVMでセキュリティを確保するFirecracker

FirecrackerもSageMaker Neoと同じくApache 2.0ライセンスでOSSとして提供され、コミュニティとの協調も進めていく。仮想化の技術を用いることで、コンテナ環境におけるセキュリティの課題を解消するサービスとして、注目度も高いと思われる。

気軽なナイトパーティと思いきや、新発表ラッシュでまったく気の抜けない内容だったデサントス氏のNight Live。数年前であればメインデイッシュとなりそうな新サービスが満載で、高レイヤーのマネージドサービスだけではなく、基盤のインフラ技術も着実に進化していることが伺えた。残り2回の基調講演でどういった内容が話されるか、震撼しつつも、興味は尽きないというのが正直な感想だ。