「選択肢拡大のエコシステム」こそがAndroid Wearの価値

グーグルはAndroid Wear 2.0をどんな発想で開発した? 独占インタビュー

2017年04月20日 09時00分更新

ウォッチフェイスとメッセージングに大きな変化

Singleton氏の言葉からは、グーグル側もスマートウォッチにおける重要さを「見る」ことにある……と感じていたことがよく分かってくる。特に重要なポイントが「ウォッチフェイス」だ。

Singleton:Android Wearの最初のバージョンで人々がなにを好んだかは、はっきりわかっています。

まずウォッチフェイスを使い分けることです。これが一番の用途でした。

つぎが「ノーティフィケーション(通知)」ですね。しかし、実際にどんなものに注意を払っているかを観察すると、みな「他人からやってくる情報」を気にしていました。ですから、すべてのノーティフィケーションの中で、メッセージングがもっとも重要だ、ということです。だから我々はそこに大きな改良を加えようと考えたんです。今回、ワンタップでその時に適切なメッセージを返信できるようにしたのも、そのためです。

現在のウォッチフェイスでも様々な情報が出せますが、今後は対応アプリケーションとの連携により、より多彩な情報を表示できるようになります。

スマートフォンは、生活の中のこまぎれの時間で情報を「読み書きする」機械、と定義できる。PCに比べ、1回の使用時間で画面を注視している時間は短いが、数分から十数分、という、ある程度まとまった時間、画面を見続けるデバイスだ。

一方でスマートウォッチは、スマートフォンよりもさらに細分化された時間の中にいる。1日の間で時計を見る回数は非常に多いが、画面を見る時間は数秒から数十秒。積み重ねてもスマートフォンよりずっと短い。

その中でさっと見られる場所であるウォッチフェイスの価値を上げること、重要な通知であるメッセージ系の操作を楽にすることが、スマートウォッチの快適さアップにつながる……という判断なのだろう。

しかし、小さい画面でのメッセージングには問題もある。「操作」だ。グーグルは音声を重視しており、そこはAndroid Wear 2系でも同様だ。グーグル全体での共通インターフェイスとなりつつある「Googleアシスタント」も、今回、Android Wearに搭載された。

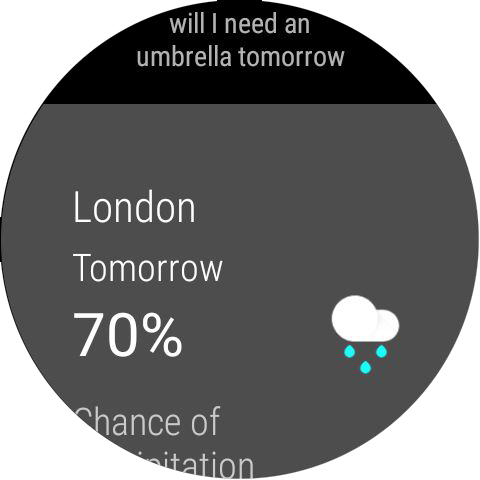

Singleton:Googleアシスタント搭載で、声によって様々な質問ができるようになります。「今日のこれからの天気は?」などと聞けば、答えがスマートウォッチの画面に表示されます。レストランの予約などもできます。

だが、それだけでなく、より「短時間で使える」方向での改良が行われた。キーワードは「機械学習」だ。

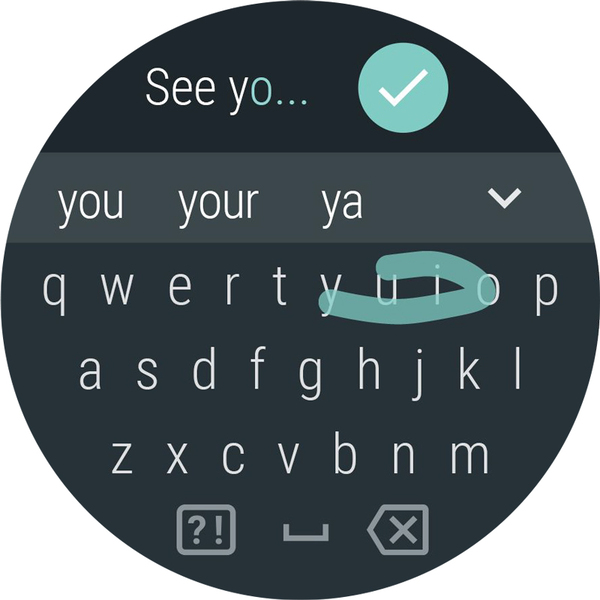

Singleton:Android Wearにおいては音声入力も広く使われていますが、すべてのシーンにおいて音声が使えるわけではありません。話せない時……例えば会議中などにさっと返信だけを行いたい場合には、音声を使わない方法が必要です。機械学習の技術は、その時にどう返信すべきかを判断するために使われており、適切なメッセージが表示され、ワンタップで返信できます。

このあたりは、日本語での活用や精度の点も含め、長期の観察が必要かと思う。しかし、機械学習はグーグルの主戦場であり、UIへの活用も必然。どこまでクオリティが上がるのか、どんな方向性になるのかなど、個人的にも興味をそそられる。