Ryzenで初めて実装された

AMD独自のインターコネクト

ところでコアそのものとは関係ないが、もう一つRyzenを構成する重要な要素があるので、これも一緒にご紹介したいと思う。それは内部のインターコネクトにまつわる話である。

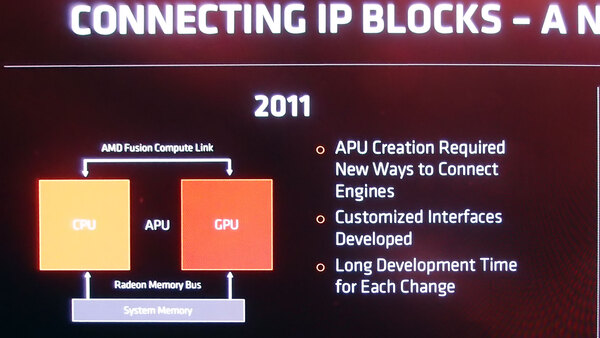

インターコネクトの重要性が最初に認識されたのは、AMD初のAPUであったLlanoの世代である。この時AMDは独自のAMD Fusion Compute Linkを開発して実装、続いてその後も世代毎に改良を加えながら独自Linkを利用し続けた。

理由はあって、当時のAPUで利用できるような適切なインターコネクトが存在しなかったからだ。ただその後Fusionの機能が上がり、部分的なキャッシュコヒーレンシーがだんだん取り込まれていくようになると、そのたびごとにその機能を追加したり、バスを分離したり、と結構複雑なことになっていた。

こうしたカスタマイズのコストを削減したい、というのがCTOだったPapermaster氏の強い願いであったという。

余談になるが、28nm世代ではGlobalfoundriesの28SHPという、事実上AMD専用のハイパフォーマンスプロセスを利用していたが、14nm世代ではバルクの14LPPを使っている。

これも同じことで、専用プロセスをわざわざ開発して利用するのはコストがかかりすぎるので、汎用プロセスを使ってコストを削減したいという強い欲求があったのだそうだ。

実際専用プロセスの場合、まずファウンダリーにそのプロセスを開発してもらうためのコストがかかるし、EDAツールもそのプロセスの特徴にあわせたスペシャル版が必要になる。

そうした追加コストを誰が被るか、というのはどれだけそのプロセスが他にも転用できるかで変わってくるが、いずれにせよAMDがコスト0で利用できるという話には絶対にならない。

おまけにGlobalfoundriesの28SHPは立ち上げにやや苦労した関係で製品投入まで遅れることになったため、その繰り返しは絶対に避けたかったのだろう。

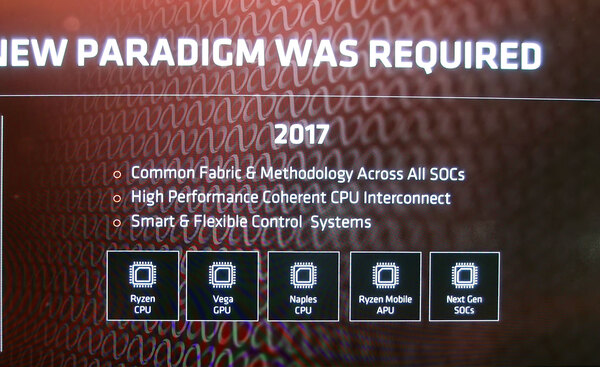

そうしたことから、SoC内部のインターコネクトも、汎用のものを共通で使うという方針が定められ、これを最初に実装したのがRyzen、次いでVEGA/Naplesということになり、その後に出てくるRyzen Mobileもこれを継承するという。このインターコネクトの名前が、Infinity Fabricである。

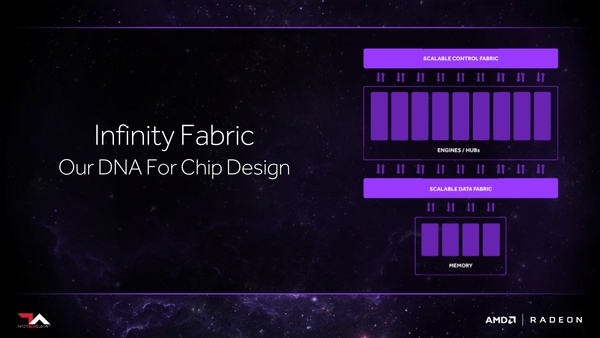

これはあくまでもAMD独自のインターコネクトで、SoC内部のモジュール間や、MCM(Multi-Chip Module)のチップ間、さらには1枚のボード上の複数チップの間の接続にも利用可能と説明されている。

逆に言えばボードの外(Papermaster氏の表現では“Out of box”)に使うことは考えていないという。AMDはこうしたOut of boxの接続には業界標準規格を使うつもりで、そうした標準規格がおよばない内部の接続のみに、このInfinity Fabricを利用するとしている。

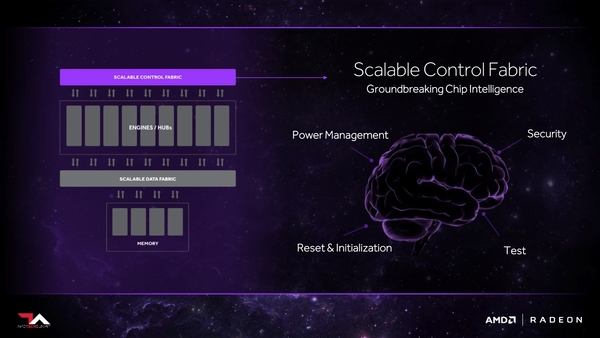

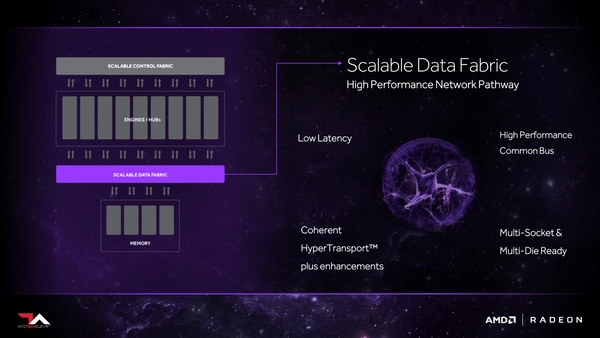

とはいえ、AMDの独自インターコネクトなのであまり意味のある説明はないのだが、大きくScalable Control FabricとScalable Data Fabricの2つから構成されることがわかっている。

おもしろいのは上のScalable Data Fabricの画像で、HyperTransportの名前が出てくることだが、Papermaster氏曰く、HyperTransportのアイディアを拡張したという話であって、物理的にHyperTransport Linkとの互換性はないし、サポートするわけではないそうだ。

この話が重要なのは、現在のRyzen 7/5自身もおそらくInfinity Fabricを利用していると思われるのだが、それよりもVegaとRyzen Mobileのことだ。

現在のAPUの後継はRyzen Mobileになるわけだが、ここに集約されるGPUコアはPolarisではなくVegaであることがはっきりしたためだ。理由は簡単で、PolarisはInfinity Fabricに対応していない。これはPapermaster氏に確認して、明確にそうだという返事を得ているからである。

つまりPolarisは本当に過渡期の製品になりそうなことがこれでわかった。過去の例で言うならば、VLIW4構造を採用したCaymanコアのRadeon HD 6900シリーズなどがやはり短命であるが、それでもVLIW4アーキテクチャー、は一応Trinity/Richlandという第2世代APUにも採用されたことを考えると、Polarisはもっと不遇ということになりそうなのは少し残念である。

この連載の記事

-

第767回

PC

Lunar LakeはWindows 12の要件である40TOPSを超えるNPU性能 インテル CPUロードマップ -

第766回

デジタル

Instinct MI300のI/OダイはXCDとCCDのどちらにも搭載できる驚きの構造 AMD GPUロードマップ -

第765回

PC

GB200 Grace Blackwell SuperchipのTDPは1200W NVIDIA GPUロードマップ -

第764回

PC

B100は1ダイあたりの性能がH100を下回るがAI性能はH100の5倍 NVIDIA GPUロードマップ -

第763回

PC

FDD/HDDをつなぐため急速に普及したSASI 消え去ったI/F史 -

第762回

PC

測定器やFDDなどどんな機器も接続できたGPIB 消え去ったI/F史 -

第761回

PC

Intel 14Aの量産は2年遅れの2028年? 半導体生産2位を目指すインテル インテル CPUロードマップ -

第760回

PC

14nmを再構築したIntel 12が2027年に登場すればおもしろいことになりそう インテル CPUロードマップ -

第759回

PC

プリンター接続で業界標準になったセントロニクスI/F 消え去ったI/F史 -

第758回

PC

モデムをつなぐのに必要だったRS-232-CというシリアルI/F 消え去ったI/F史 -

第757回

PC

「RISC-VはArmに劣る」と主張し猛烈な批判にあうArm RISC-Vプロセッサー遍歴 - この連載の一覧へ