3つ目の障害

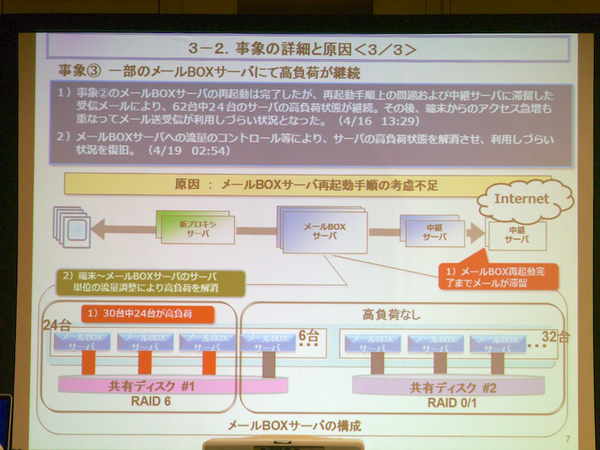

3つ目の長時間に渡った障害は、2つ目の対策として行なった、メールBOX再起動完了までに、多くの受信メールが滞留。これによって、メールサーバーの高負荷状態が継続。共有ディスク1につながる30台のうち、24台のメールBOXサーバーがこうした状況になったという。また、端末からのアクセス急増も重なり、メールの送受信がしにくい状況が続いた。

そこで、メールBOXサーバーへの流量コントロールなどにより、サーバーの高負荷状態を解消し、利用しにくい状況を復旧させた。

「メールのロストがあってはいけないということもあり、慎重に対処したため、最初の一日半は流量調整は行なわなかった。だが、高負荷状態が続いたため、流量調整に踏み切った。これを早くやっていれば、もう少し早く復旧ができた」などとした。

さらに、サービスが利用しにくい状況が続いたことで、端末とサーバー間での同期ができなくなり、端末上の連絡先情報が見えなくなるという障害も同時に発生していた。

これは、端末がメールBOXサーバーに対して、連絡先情報同期を要求し、エラー応答があると、同期処理に用いる管理情報に不一致が発生し端末の連絡先情報をクリアしてしまう仕組みが背景にある。同社では再表示を早期化するめたに、新規連絡先を1件追加し、端末とサーバー間の全データの同期を行う方法を案内して、解決を図っているという。

同社によると、今回の障害に伴って、約4万件の問い合わせがあり、そのうち、2400件が連絡先情報が見えないというものだったという。「180件で連絡先情報が復旧できない状態が発生している」という。

リアルタイム受信サービスにおいては、2012年6月27日以前に作成した連絡先情報をサーバーであずかるサービスを提供しておらず、端末とサーバー間で連絡先情報の同期が行なわれた場合、6月27日以前の連絡先情報が再表示されないという仕組みになっている。

これらの情報を活用するには、デフォルトアカウントをリアルタイム受信以外に設定するか、同社が提供するアドレス移行アプリによって、情報をサーバー側にあずける必要がある。この点の周知が徹底されていなかったことも、一部ユーザーの連絡先データの紛失につながったといえる。

再発防止策を説明

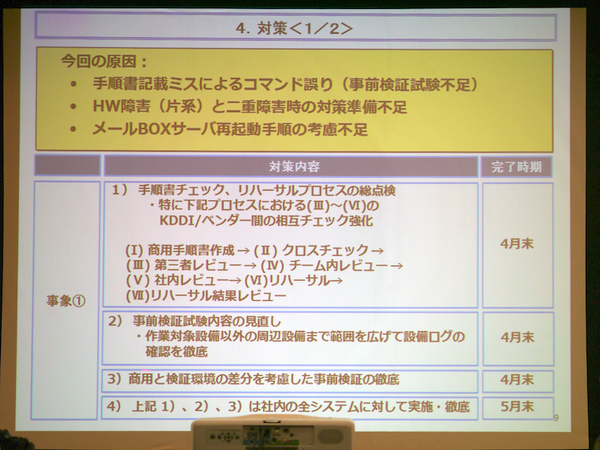

KDDI 取締役執行役員専務 技術統括本部長の嶋谷吉治氏は、「今回の障害は、手順書記載ミスによるコマンドの誤りという事前検証試験不足と、ハードウェア障害と二重障害時の対策準備不足、メールBOXサーバー再起動手順の考慮不足が原因。作業中におけるフェースセーフの考え方が不十分であった。バックアップの次のバックアップをどこまでやるのかといったことを全社規模で見直す必要がある」と説明した。

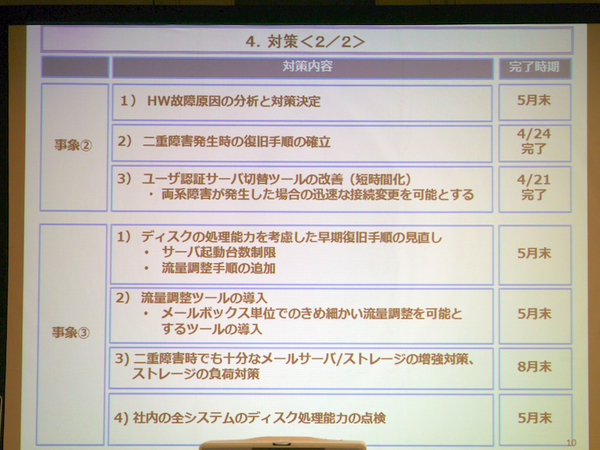

「再発防止として、手順書チェックやリハーサルプロセスの総点検、事前検証試験内容の見直し、商用と検証環境の差分を考慮した事前検証の徹底、三重障害までを視野に入れた障害発生時の復旧手順の確立、ユーザー認証サーバー切り替えツールの改善、ディスク処理能力を考慮した早期復旧手順の見直し、流量調整ツールの導入などに取り組んでいく」という。

各種ツールの導入などで3億円規模の費用を投資。「机上では2時間以内での復旧に目処がついている。今回と同じ場合では90分で回復できるようにした。お客様からは厳しい言葉をもらっている。今は大きな解約の動きなどはないが、やってはならない障害であり、強く反省をしている」などとしている。

こうした大規模な新システムの移行は約2年に一度行なわれているという。夏に予定していた新サービスに向けたシステム移行は、「改善策を講じれば、スケジュール通りにいける」としたが、「新サービスの内容については、現時点ではいえない」などと語った。

なお、今回の障害は、「すべてのサービスが停止したものではなく、約款上では、返金するという対応が発生するものではない。これを踏まえて、個別に対応していく」としている。