必要なのはGPUスペック

―― それは端末のCPUスペックに左右されるんですか? たぶん処理の問題でいろんなアルゴリズム使っていると思うので相性みたいなものはあると思うんですが。

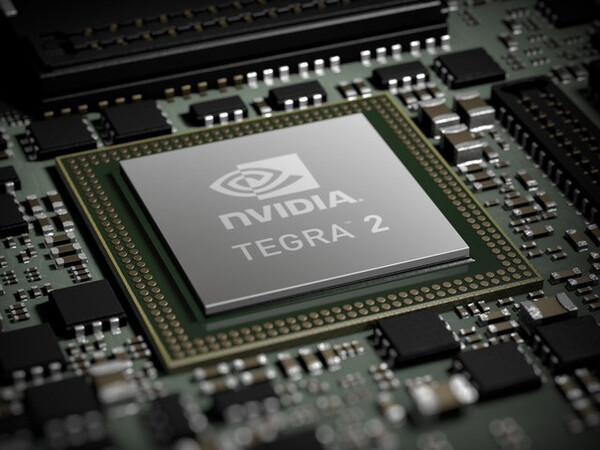

加藤 もちろんCPU性能というのも効いてきますけど、3Dの場合は中に搭載しているGPUの性能ですね。SnapdragonだとAdrenoが搭載されていますし、Tegra 2だとGeForceのGPUが搭載されていますが、そちらに直結することになります。※

※ Snapdragon、Tegra 2はどちらもケータイ用のチップセットプラットフォーム。SnapdragonはQUALCOMM社が、Tegra 2はNVIDIA社が開発している

―― すると、今だと注目はTegra 2ですか?

加藤 そうですね。今はまだちょっとカクカク感があるPlayStationくらいの性能ですが、Tegra 2を使えばPlayStation 2くらいの精細感は出せると思います。もう1つはOpenGL ESという3Dを表示するための規格(API)があるんですけど。Android OS 2.0以上であれば、バージョンが1つ上がるんですね。そうすると表現力もかなり上がるんです。OpenGL ESが1.1から2.0という新しい規格になっているので、それが大きいです。

―― 1.1と2.0で、そんなに違うんですか?

加藤 その2つは互換性がない、まったく別のバージョンになっていて、機能的にはかなり高度なものになっているんです。3Dの品質というのはすごく良くなっていて。

―― 現行で出ているAndroid OSはHoneycomb(3.0)を含めてバージョン2.x以上ですよね。夢が広がりますね。

加藤 広がりますね。われわれがやっているのは画像の認識のところをいかに正確に出せるかを研究しているので、その映像をどう美しく表示するのか、キレイなお姉さんを出すか、というのはコンテンツ屋さん、3Dモデルを作る方に期待しているところです。

―― じゃあ、初めてOpenGL ES 2.0が出てきて、「オレたちの時代が来た!」って感じなんですかね?

加藤 あ、そうですね、そうですね!

ARは未来の「ホットペッパー」

―― 今後は、どういう展開になるんでしょう?

加藤 ゲーム屋さんはいろんな3Dのモデルを持っていらっしゃいます。それをAndroidの世界、手のひらの上に登場させられますということになってくると思うんです。今のフォーマットはMikuMikuDance(MMD)というフォーマットに対応していて、ユーザーさんが自由にモデルや動きをつくったりすることができて、それをここに表示して、与えられたモデルをただ見るだけじゃなく、それを自分でさわったり動かしたりできるんです。そういうプラットフォームになればいいなと。

―― ニコニコ動画の初音ミクみたいに?

加藤 そうですね。前回のさっぽろ雪まつりでデモしたものは、正にPさん(MMD作家)が作られたものですね。お願いして、ぜひ使わせてくださいということでお話をしました。

―― 夢が広がりますよね。ニコニコ動画に手のひらARの映像が入ると一気にドーンと来るような気がしますよね。今ある3Dモデルはそんなに簡単に使えるものですか?

加藤 ただ、ニコニコ動画で上がっているようなものはPCで動かすことを前提に作られているのでデータサイズが大きいんですよね。1つのデータが数MBとか。いろんなデータがあるので一概には言えないんですけど、雪まつりで使った初音ミクの場合でも、ポリゴンの数が4000~5000くらいのレベル、一般的にPCで見られているのは軽く1万は超えてるんです。それでも、Tegra 2になればそのまま引っ張ってこられるのかな、と思っています。

―― なるほどGPUのところがいちばんのネックになっているわけですね。基本的にじゃあさっきのインターフェースなり、手をタテにすると……といったことを考えていくとして、今後のことを考えたらどうなります? 10年後のことを考えたらどこまでいけると思います? 技術者としての夢を語っていただけるとたいへんうれしいのですが。

加藤 これは映像認識のARですが、ロケーションベースのARというのは別で研究しているんですね。GPSを使った「セカイカメラ」のARも同時に考えられているんですね。ユーザーがどこにいてどちらを向いているかをベースにARタグを表示している。将来は、画像認識と場所認識のARがハイブリッドになるんじゃないかと。

今だと、例えば地下街ではGPSをロストして使えません。地上にいたとしても新宿のように高層ビルがたくさんあるところでは使えなかったりとか、認識したとしても10~20メートルずれてしまったり、レストランにタグを埋めても全然使えなかったりする。でも画像認識であれば、GPSが使えない場所で画像が使えるんです。GPSで大まかな場所を示し、お店の看板をタグとしてクーポンを手に入れたり、ということがもし実現できるとしたら、新しいプラットフォームになることができるんじゃないかと。

―― そうですよね。カメラで撮った画像からサーバーに問い合わせると。ホットペッパーが全部ARになるようなイメージですね。けっこうそれ大変じゃないですか? リクルートさんが大喜びしそうだ!(笑)

加藤 個人的には、やりたいと思いますね。

―― そうか、なるほどね。将来はそれが当たり前の世界になるんですかねえ~。

加藤 そのときはこういったケータイの形ではなくなっているかもしれません。いちいちかざすというわけではなく、メガネのようにかけるHMD(Head Mount Display)のような形になっているかもしれない。ポケットの中のスマートフォンと無線でつながっているような。

―― なるほど、いろんな食べものとか、ショッピングとかのフィルターがあって。

加藤 そういう風になれば広告のビジネスという形で、KDDIがプラットフォームを提供するようなイメージになるのかなと。

―― 「回線はauのヤツを使ってください」「認識できるのはKDDIだけです」とか、そういう囲い込み戦略ができますね。うちらはそういうの結構好きなんで、例えば秋葉原で今やってるアニメのキャラが案内してくれるサービスとかできるんじゃないかと思ったんですけど、今日の話を聞いていると近い将来にできるんじゃないかと思いました。

加藤 できますねー。

―― でもバッテリーの消耗って激しいんじゃないですか?

加藤 ほぼカメラの部分だけですから、そんなには使いませんね。さっぽろ雪まつりのときは予備のバッテリーを持っていきはしたんですけど、朝にフル充電したまま、夜までカラッポになることなく使えました。

―― じゃあさっきのクーポンもそんな難しく考えなくてもいいってことですね。なるほど。

(次ページに続く)